【搜索客社区日报】第2018期 (2025-04-09)

https://zhuanlan.zhihu.com/p/26631768854

2.RAG结合上下文提升召回成功率|Claude

https://zhuanlan.zhihu.com/p/721306620

3.RAG探索之路的血泪史及曙光

https://zhuanlan.zhihu.com/p/664921095

4.加速 HNSW 图的合并

https://mp.weixin.qq.com/s/5s2xuXKaTmznTo7bijeVqA

编辑:kin122

更多资讯:http://news.searchkit.cn

https://zhuanlan.zhihu.com/p/26631768854

2.RAG结合上下文提升召回成功率|Claude

https://zhuanlan.zhihu.com/p/721306620

3.RAG探索之路的血泪史及曙光

https://zhuanlan.zhihu.com/p/664921095

4.加速 HNSW 图的合并

https://mp.weixin.qq.com/s/5s2xuXKaTmznTo7bijeVqA

编辑:kin122

更多资讯:http://news.searchkit.cn 收起阅读 »

【搜索客社区日报】第2017期 (2025-04-08)

https://faun.pub/how-to-config ... 29bb4

2. 一个月撸150亿的日志,你来你也行(需要梯子)

https://medium.com/%40lunguh/h ... 33ab4

3. 无痛更新ES证书可行不?(需要梯子)

https://medium.com/%40ashishof ... b2a7c

编辑:斯蒂文

更多资讯:http://news.searchkit.cn

https://faun.pub/how-to-config ... 29bb4

2. 一个月撸150亿的日志,你来你也行(需要梯子)

https://medium.com/%40lunguh/h ... 33ab4

3. 无痛更新ES证书可行不?(需要梯子)

https://medium.com/%40ashishof ... b2a7c

编辑:斯蒂文

更多资讯:http://news.searchkit.cn

收起阅读 »

【搜索客社区日报】第2015期 (2025-04-03)

https://mp.weixin.qq.com/s/bgDd82lj0jBUWifLMNByjw

2.自动化新时代:OWL、CRAB 与 MCP 如何打通“最后一公里”

https://mp.weixin.qq.com/s/jvQRFRlADYJUtDyYQ29qQQ

3.Nvidia 收购 Run:ai 后开源的 KAI-Scheduler vs HAMi:GPU 共享的技术路线分析与协同展望

https://mp.weixin.qq.com/s/6qEdQjjh3YeSnCxGymHnHQ

4.学习如何设计大型系统

https://github.com/donnemartin ... rimer

编辑:Se7en

更多资讯:http://news.searchkit.cn

https://mp.weixin.qq.com/s/bgDd82lj0jBUWifLMNByjw

2.自动化新时代:OWL、CRAB 与 MCP 如何打通“最后一公里”

https://mp.weixin.qq.com/s/jvQRFRlADYJUtDyYQ29qQQ

3.Nvidia 收购 Run:ai 后开源的 KAI-Scheduler vs HAMi:GPU 共享的技术路线分析与协同展望

https://mp.weixin.qq.com/s/6qEdQjjh3YeSnCxGymHnHQ

4.学习如何设计大型系统

https://github.com/donnemartin ... rimer

编辑:Se7en

更多资讯:http://news.searchkit.cn 收起阅读 »

【搜索客社区日报】第2014期 (2025-04-02)

https://mp.weixin.qq.com/s/YRxn8Ur9Ykl6Q0ZKyuWbxQ

2.深度剖析Elasticsearch倒排索引数据结构

https://mp.weixin.qq.com/s/hDVxDCLD9UQbBk7sqcoPFQ

3.为什么 Apache Doris 是比 Elasticsearch 更好的实时分析替代方案?

https://mp.weixin.qq.com/s/JgjE-hk_MpRyXFHPhhYnyA

4.RAG与微调的实用比较

https://mp.weixin.qq.com/s/VHq_3mCNP3G9rakKPcbJtg

编辑:kin122

更多资讯:http://news.searchkit.cn

https://mp.weixin.qq.com/s/YRxn8Ur9Ykl6Q0ZKyuWbxQ

2.深度剖析Elasticsearch倒排索引数据结构

https://mp.weixin.qq.com/s/hDVxDCLD9UQbBk7sqcoPFQ

3.为什么 Apache Doris 是比 Elasticsearch 更好的实时分析替代方案?

https://mp.weixin.qq.com/s/JgjE-hk_MpRyXFHPhhYnyA

4.RAG与微调的实用比较

https://mp.weixin.qq.com/s/VHq_3mCNP3G9rakKPcbJtg

编辑:kin122

更多资讯:http://news.searchkit.cn 收起阅读 »

INFINI Labs 产品更新 | Coco AI 0.3 发布 – 新增支持 Widget 外部站点集成

INFINI Labs 产品更新发布!此次更新涵盖 Coco AI 、Easysearch 等产品多项重要升级,重点提升 AI 搜索能力、易用性及企业级优化。

- Coco AI v0.3 作为 开源、跨平台的 AI 搜索工具,新增快捷键设置,支持多个聊天会话等功能。

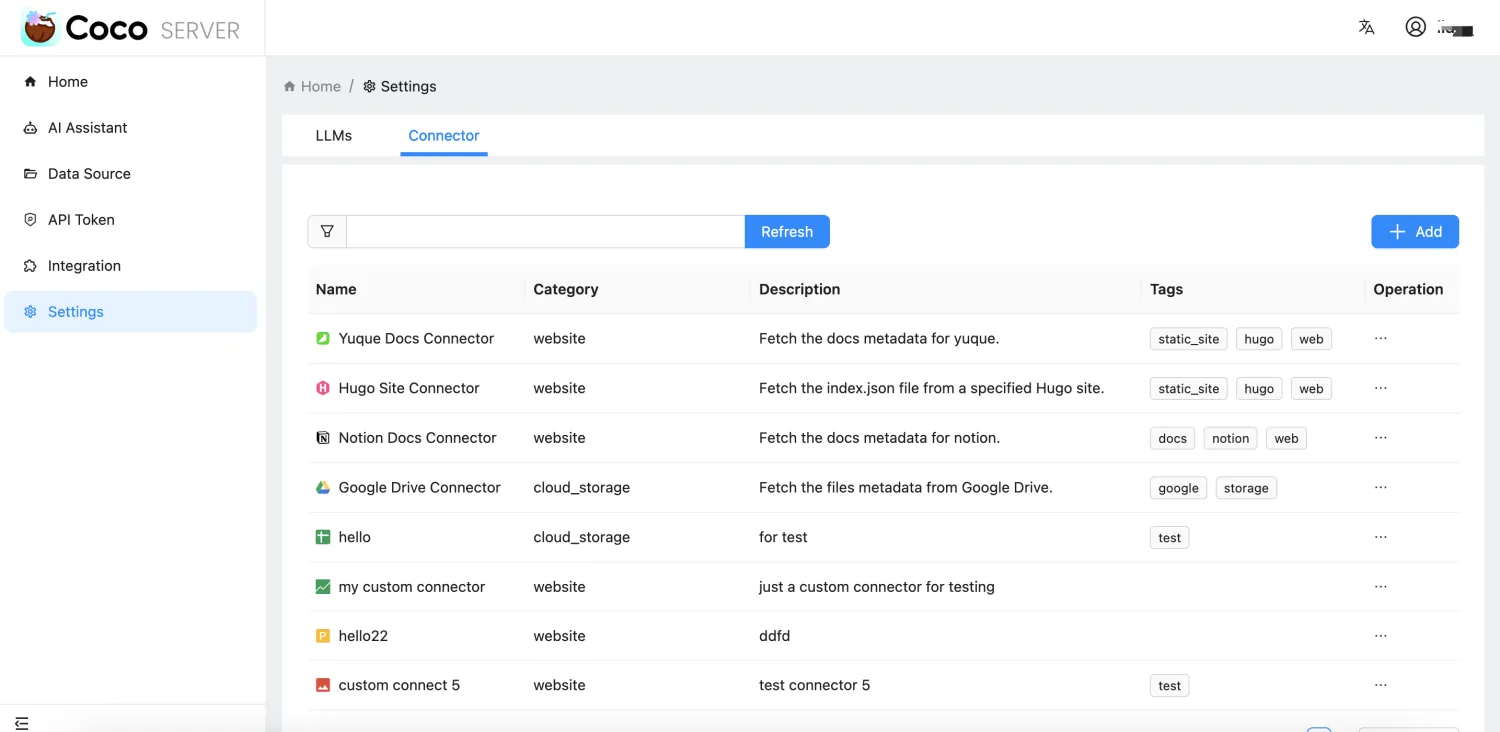

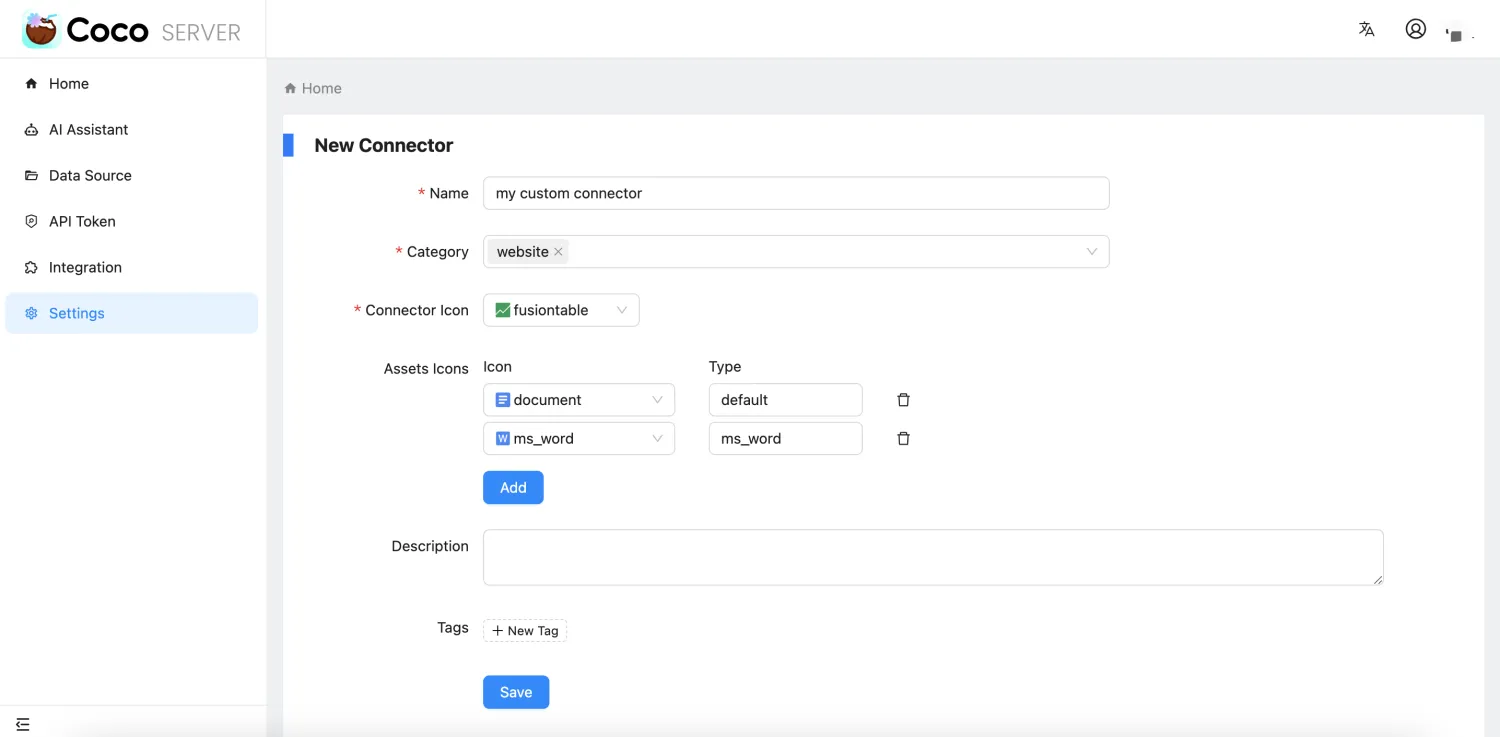

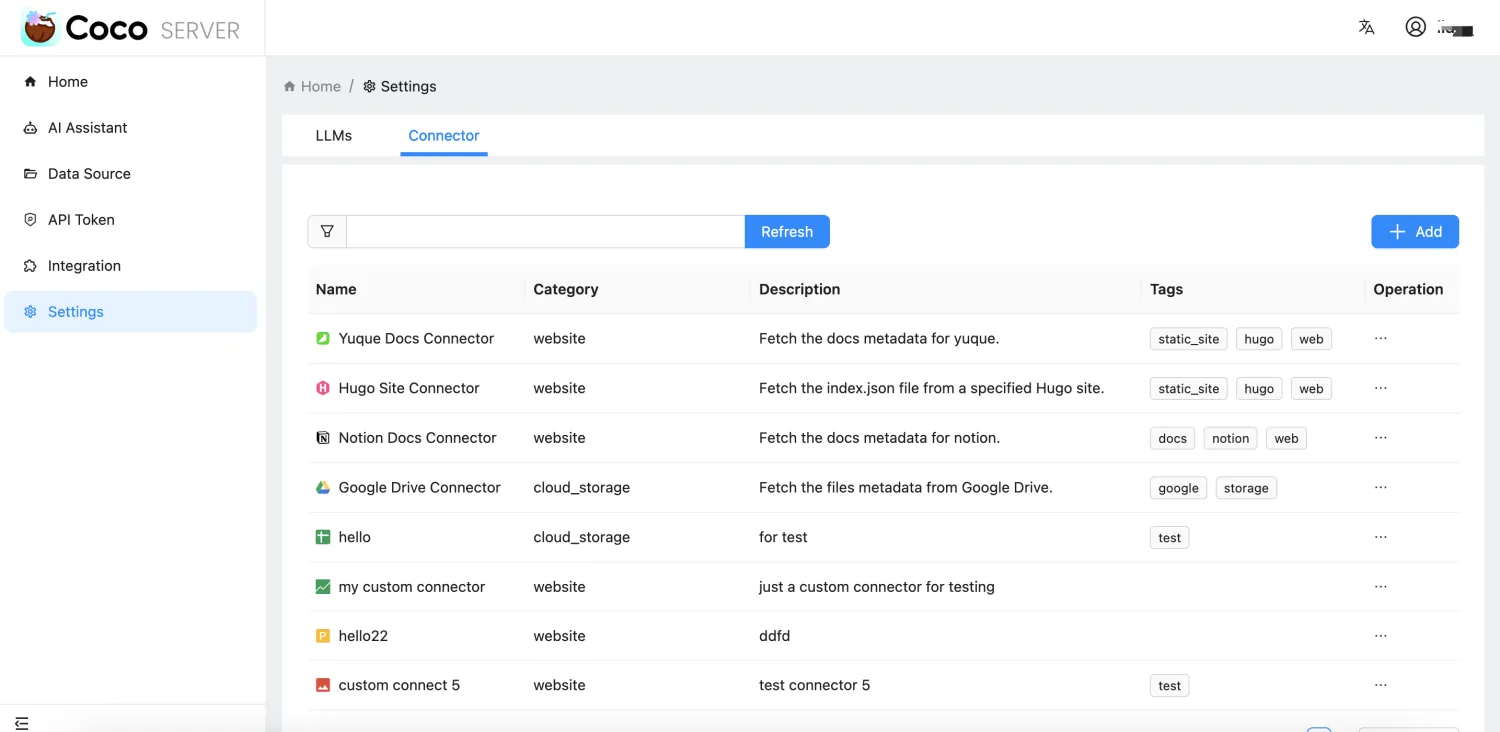

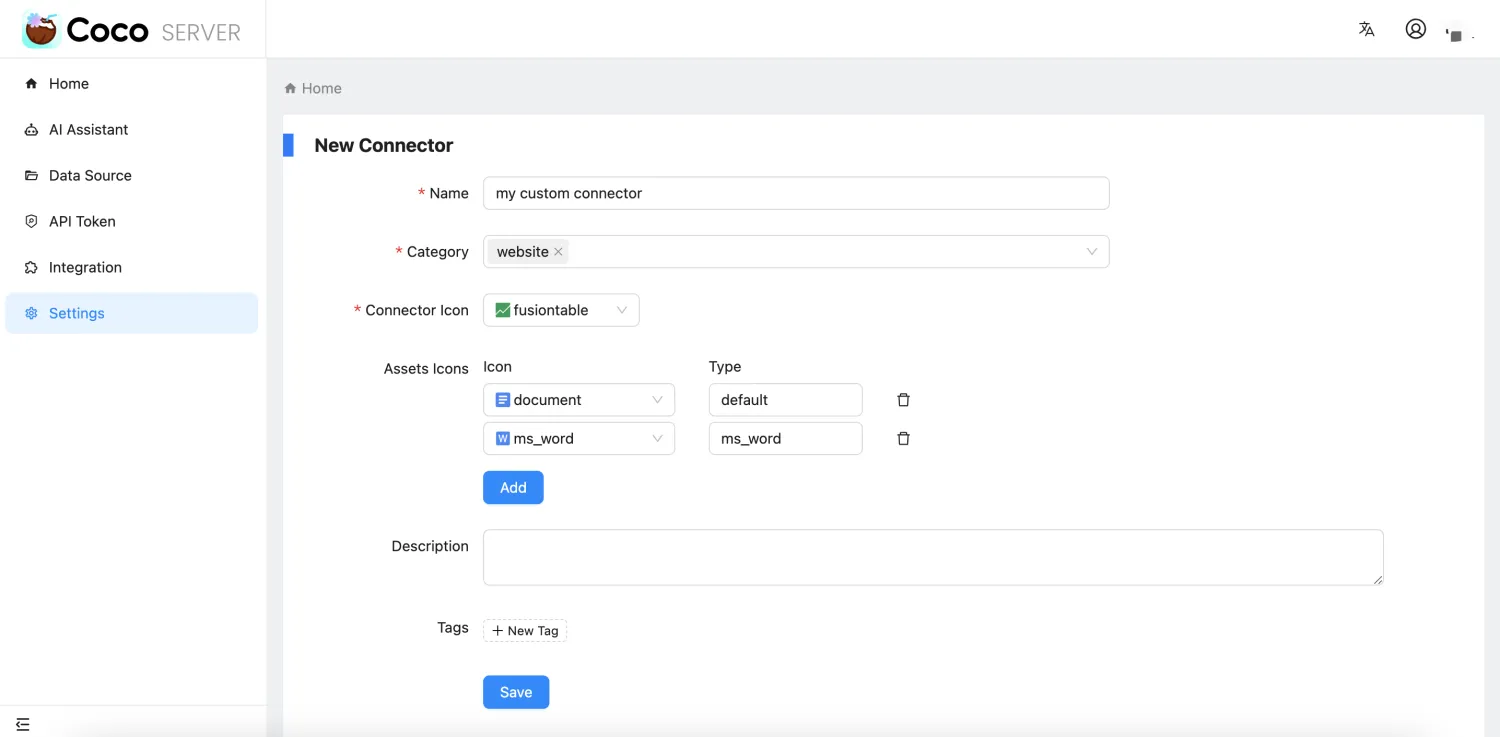

- Coco AI Server 新增连接器 UI 管理支持,允许用户通过请求头传递 websocket 会话 ID。

- INFINI Easysearch v1.12.0 集成 AI 向量搜索,优化 Rollup 能力。

- INFINI Console、Gateway、Agent、Loadgen、Framework 关键问题修复,优化 Security 处理与整体用户体验。

Coco AI v0.3

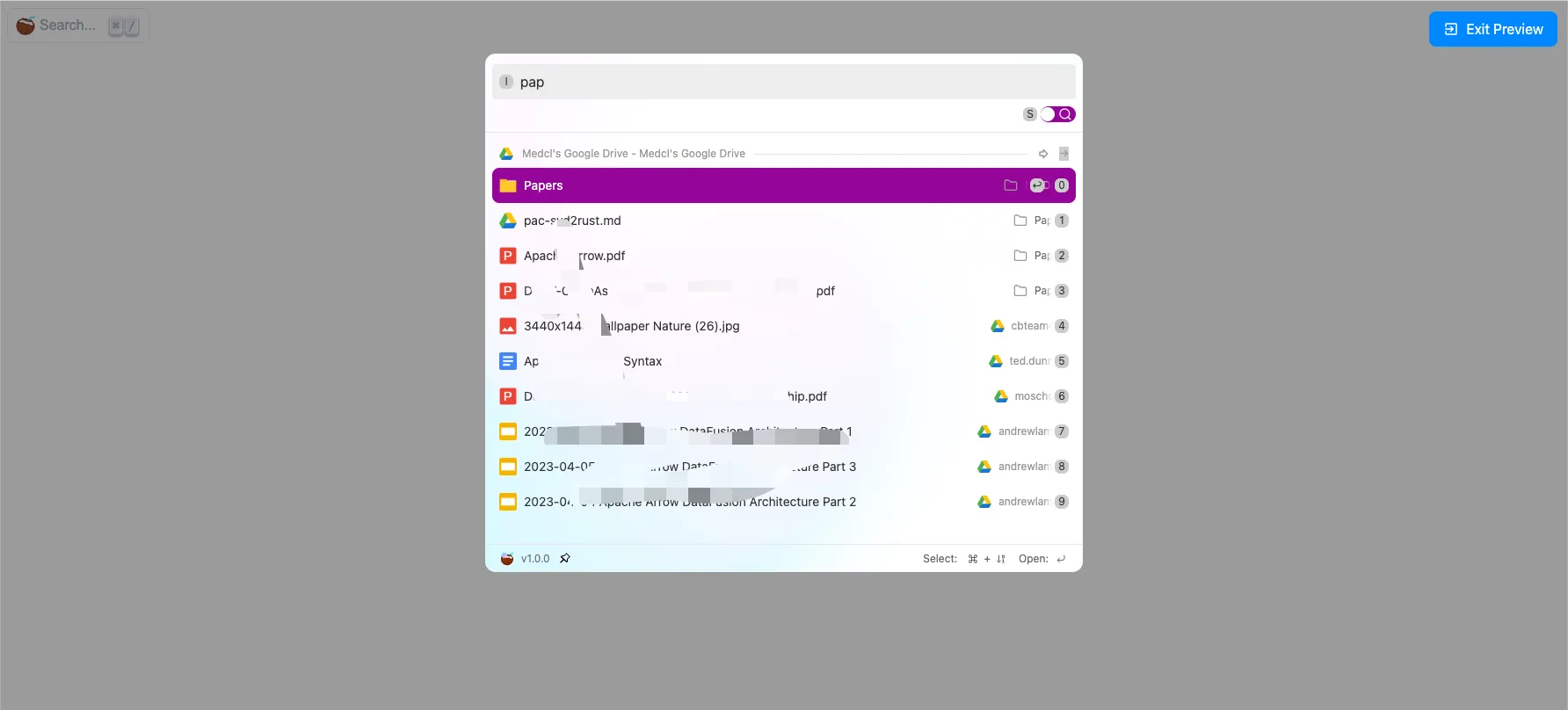

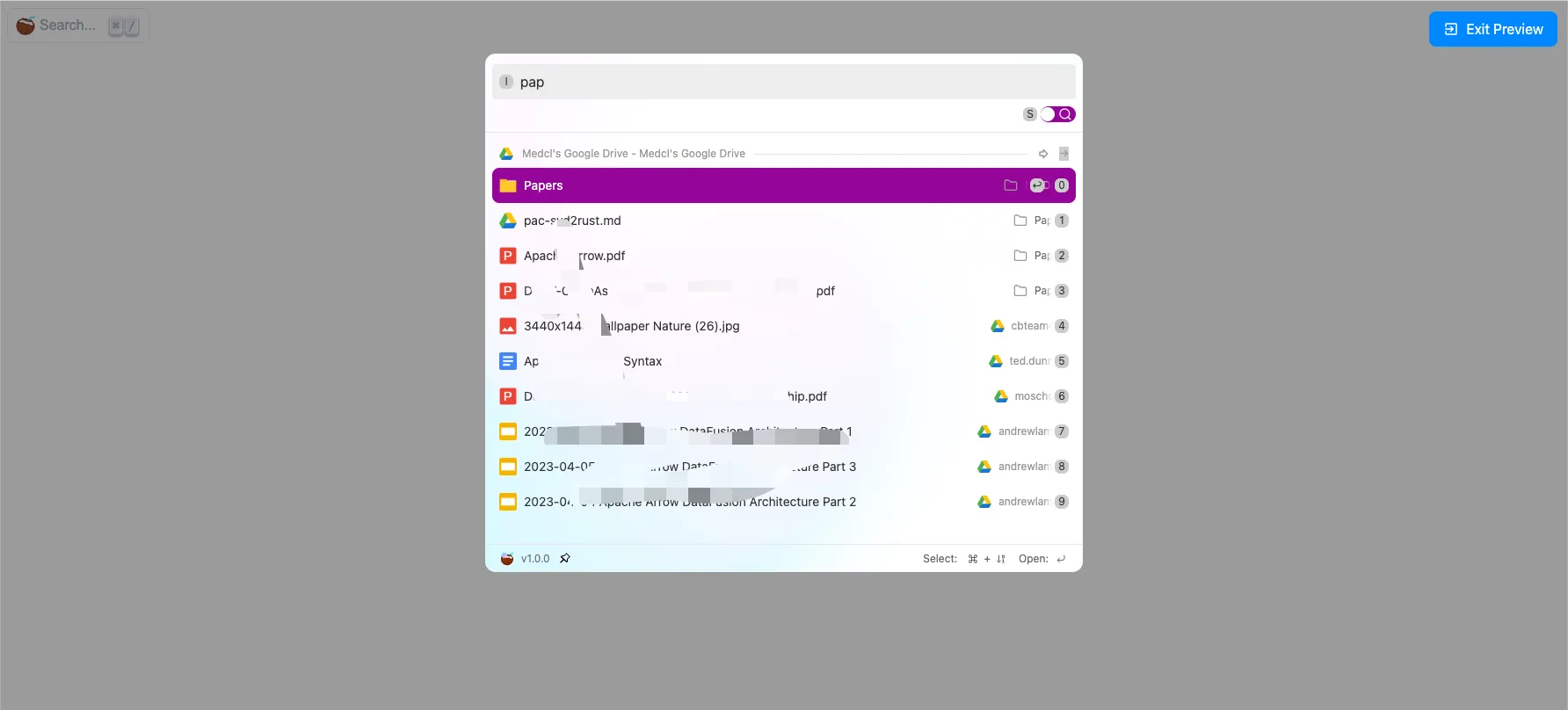

Coco AI 是一个完全开源、跨平台的统一 AI 搜索与效率工具,能够连接并搜索多种数据源,包括应用程序、文件、谷歌网盘、Notion、语雀、Hugo 等本地与云端数据。通过接入 DeepSeek 等大模型,Coco AI 实现了智能化的个人知识库管理,注重隐私,支持私有部署,帮助用户快速、智能地访问信息。

Coco AI v0.3.0 视频演示。

Coco AI 本次详细更新记录如下:

Coco AI 客户端 v0.3.0

功能更新

- 新增快捷键设置

- 支持多个聊天会话

问题修复

- 应用程序搜索移除图标不正常的候选列表

优化改进

- 重构代码,复用前端组件提供 Web Widget 外部引入

Coco AI 服务端 v0.3.0

功能更新

- 新增连接器 UI 管理支持

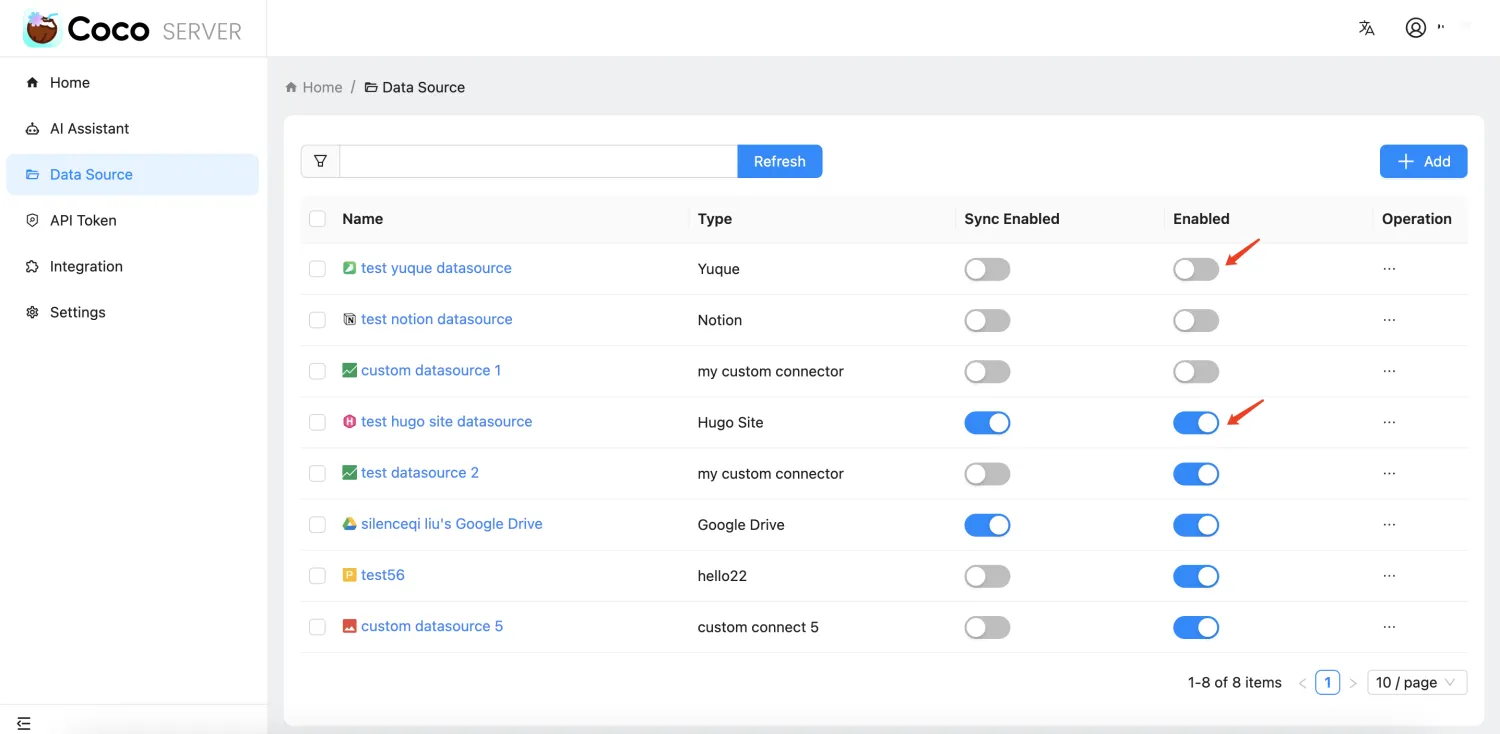

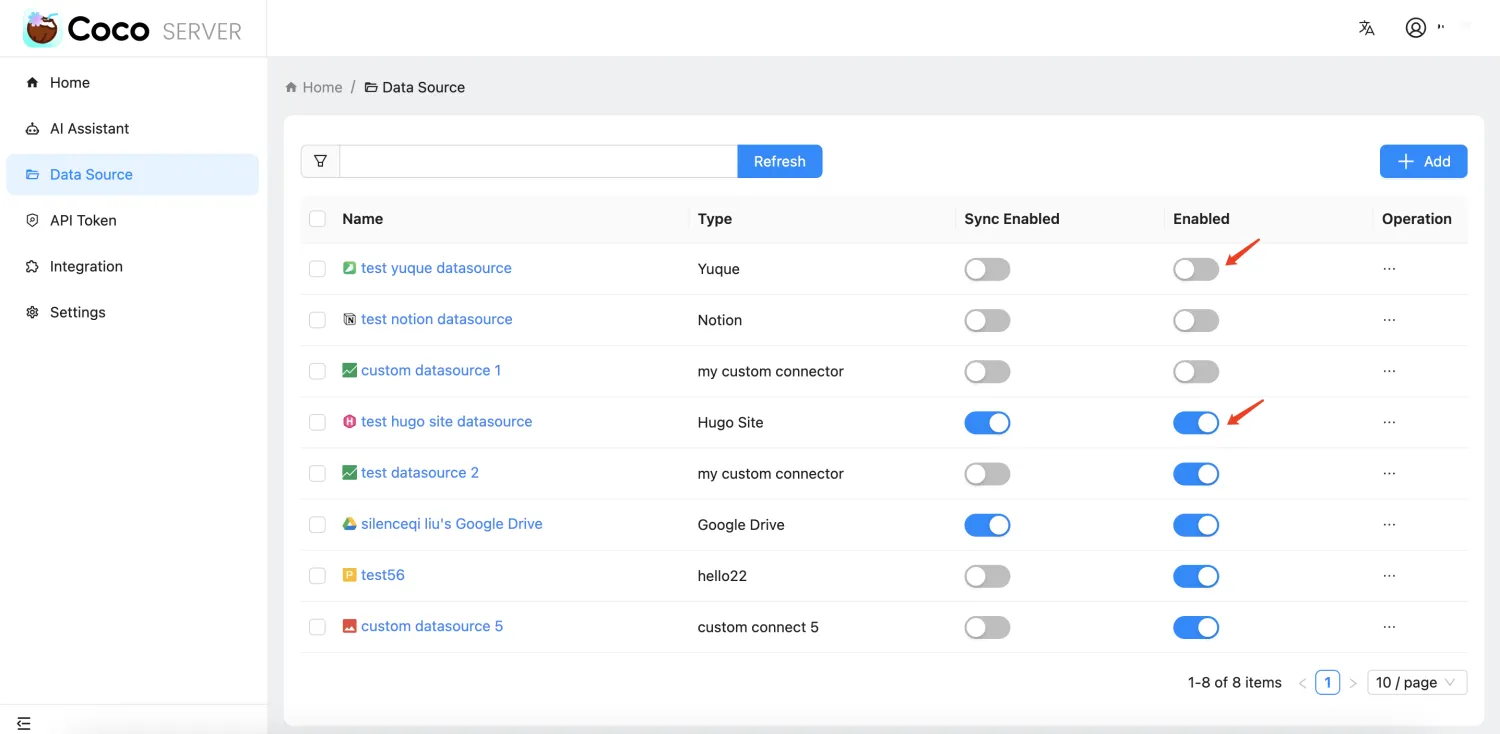

- 根据数据源的启用状态控制相关文档的可搜索性

- 允许用户通过请求头传递 websocket 会话 ID

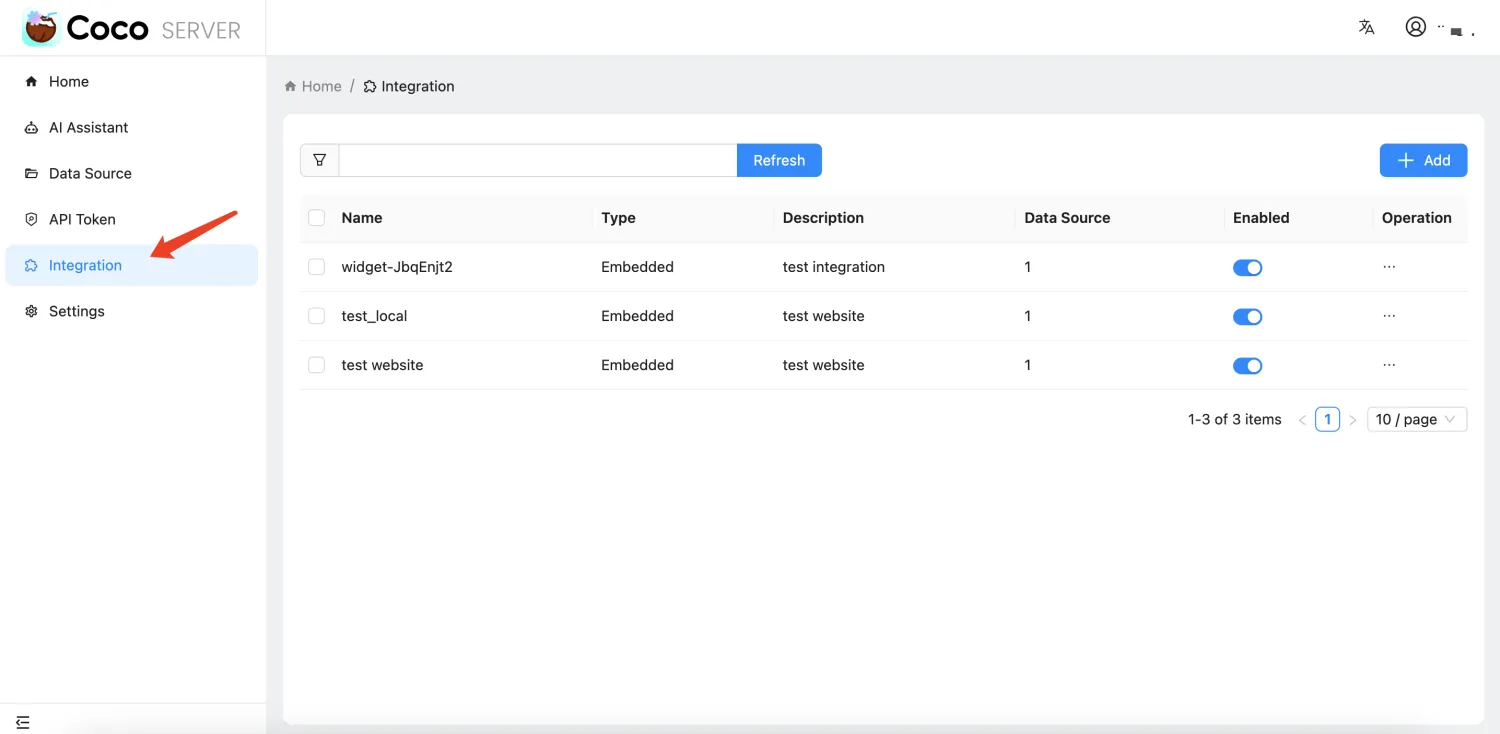

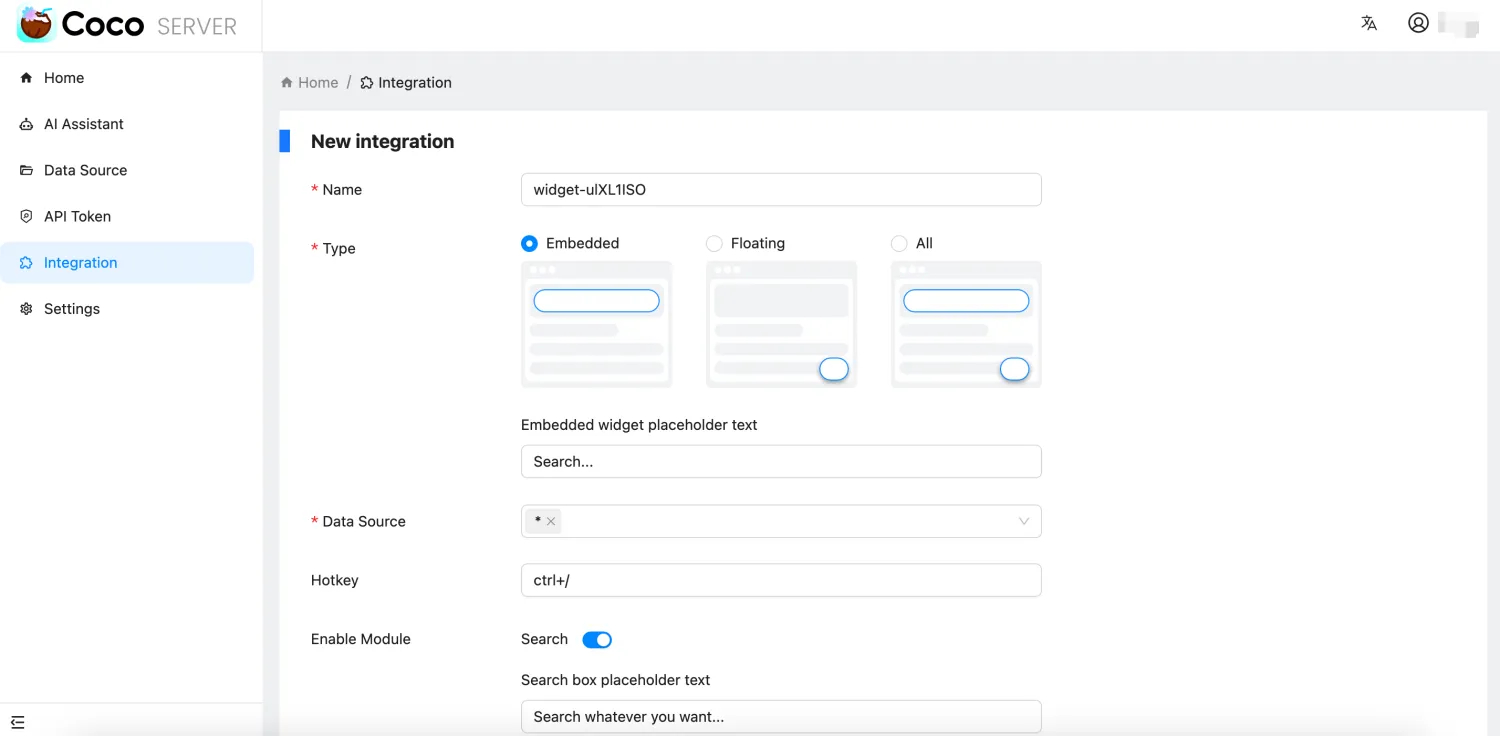

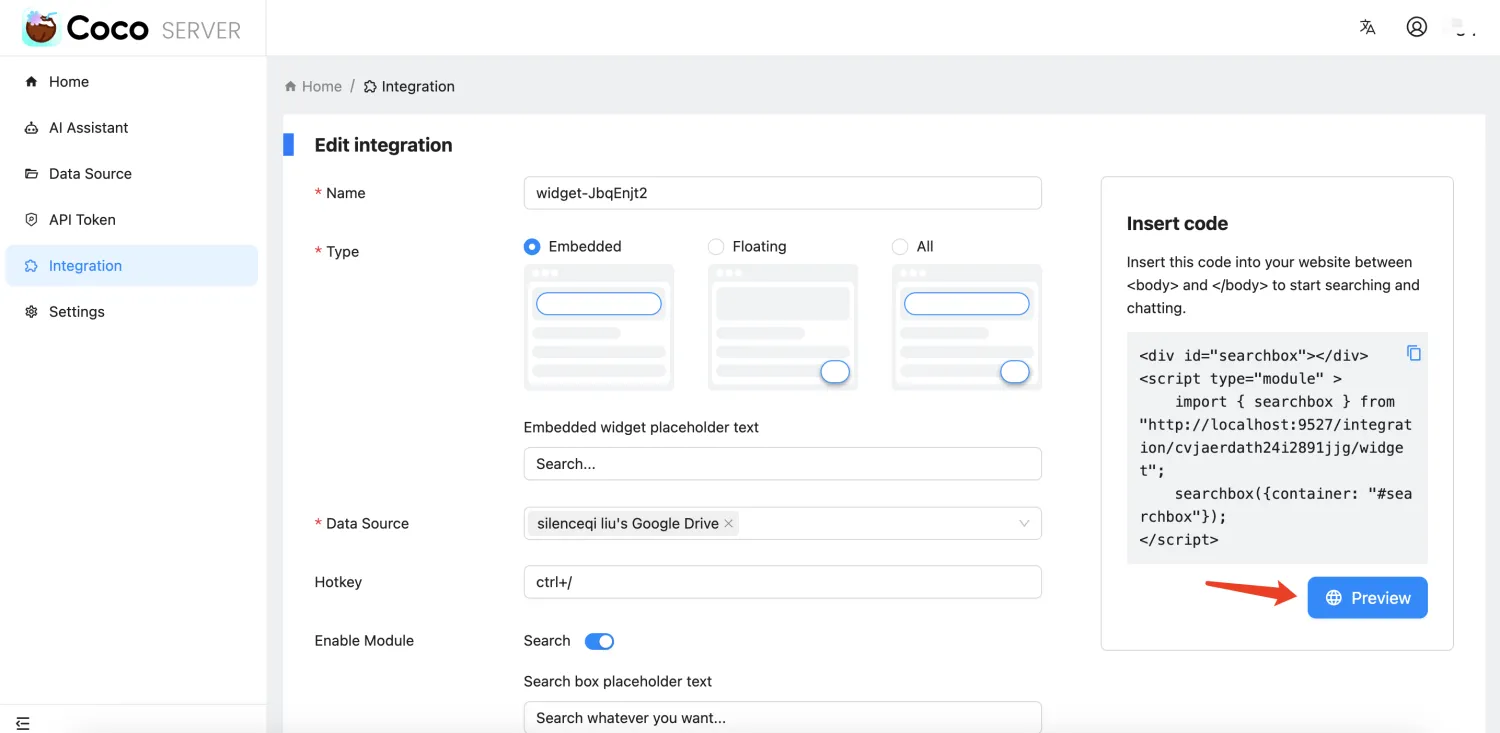

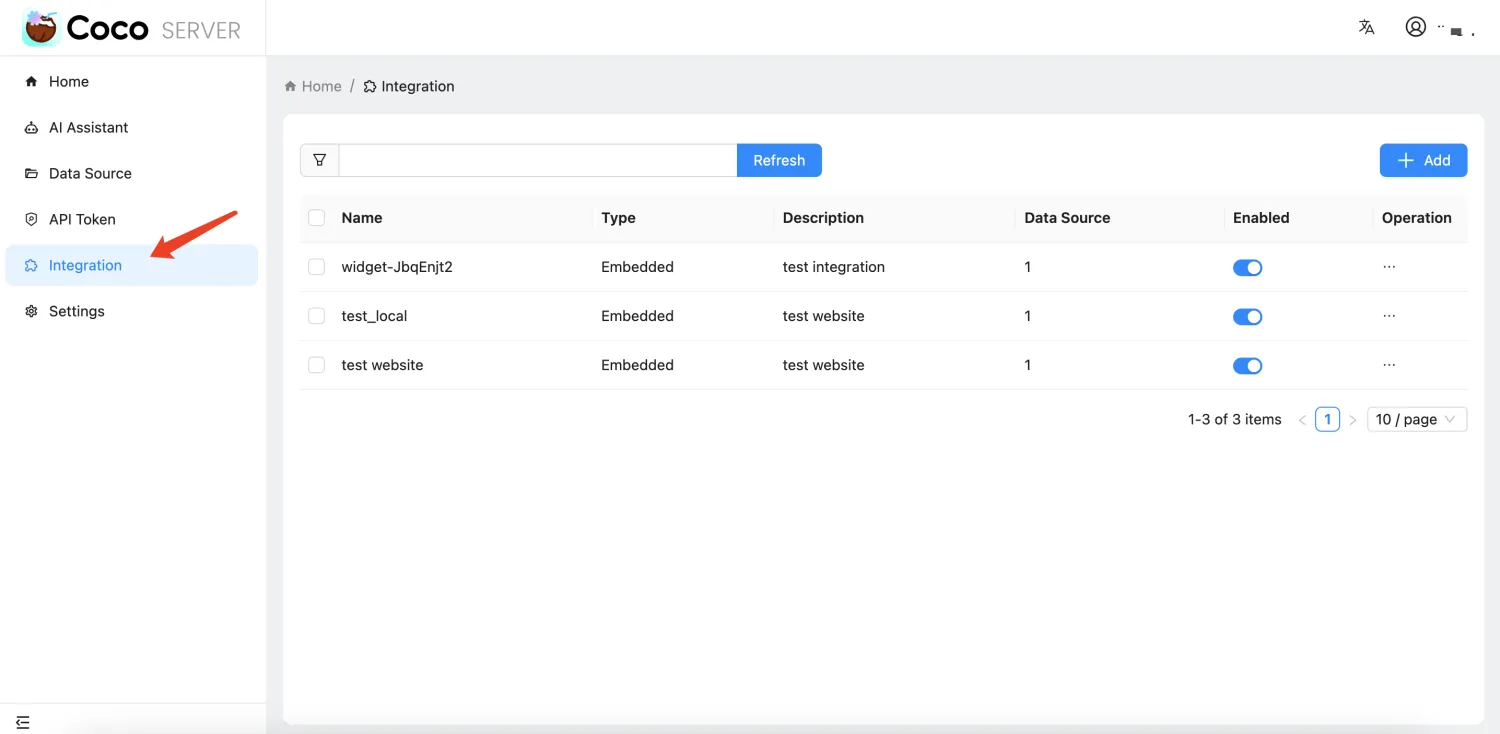

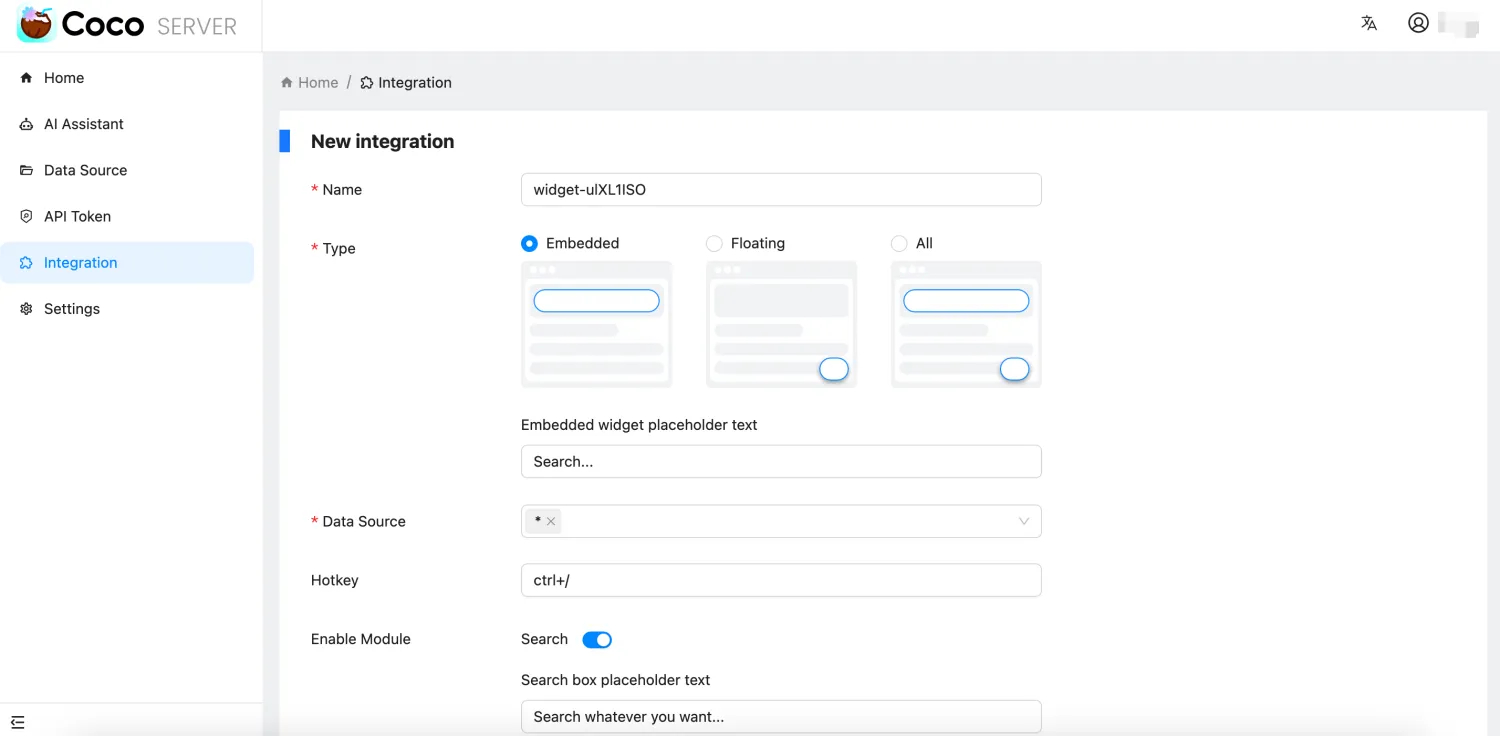

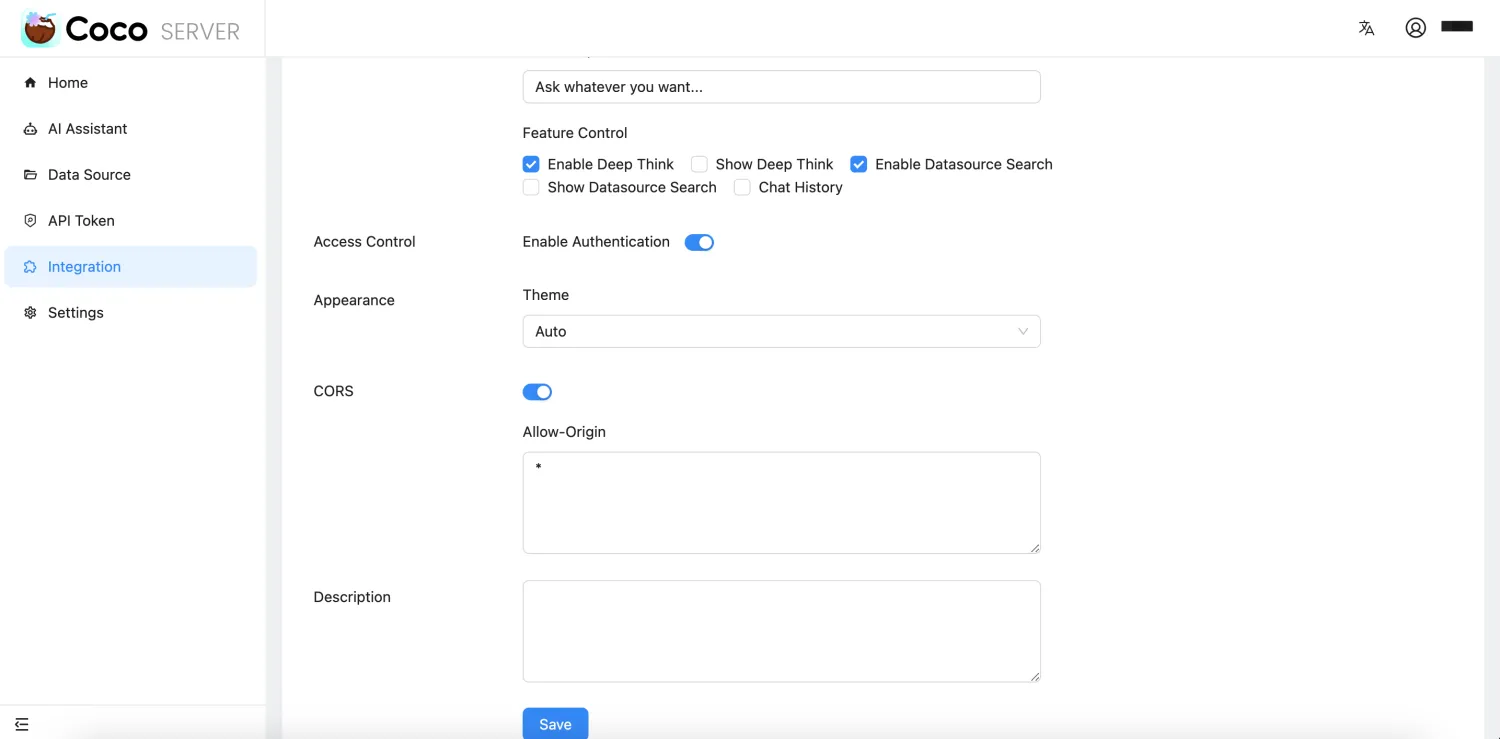

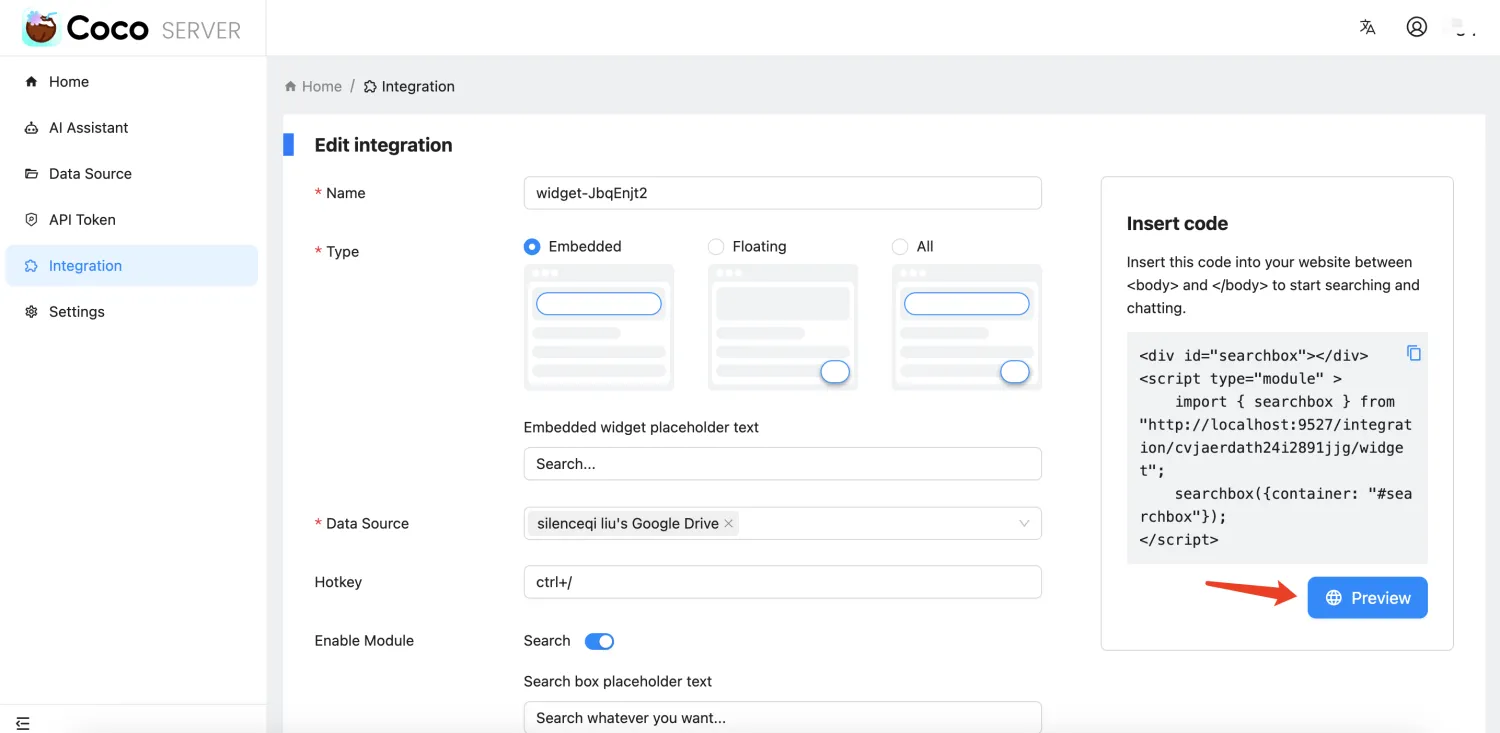

- 新增集成组件管理

- 新增搜索框小组件,便于嵌入网站

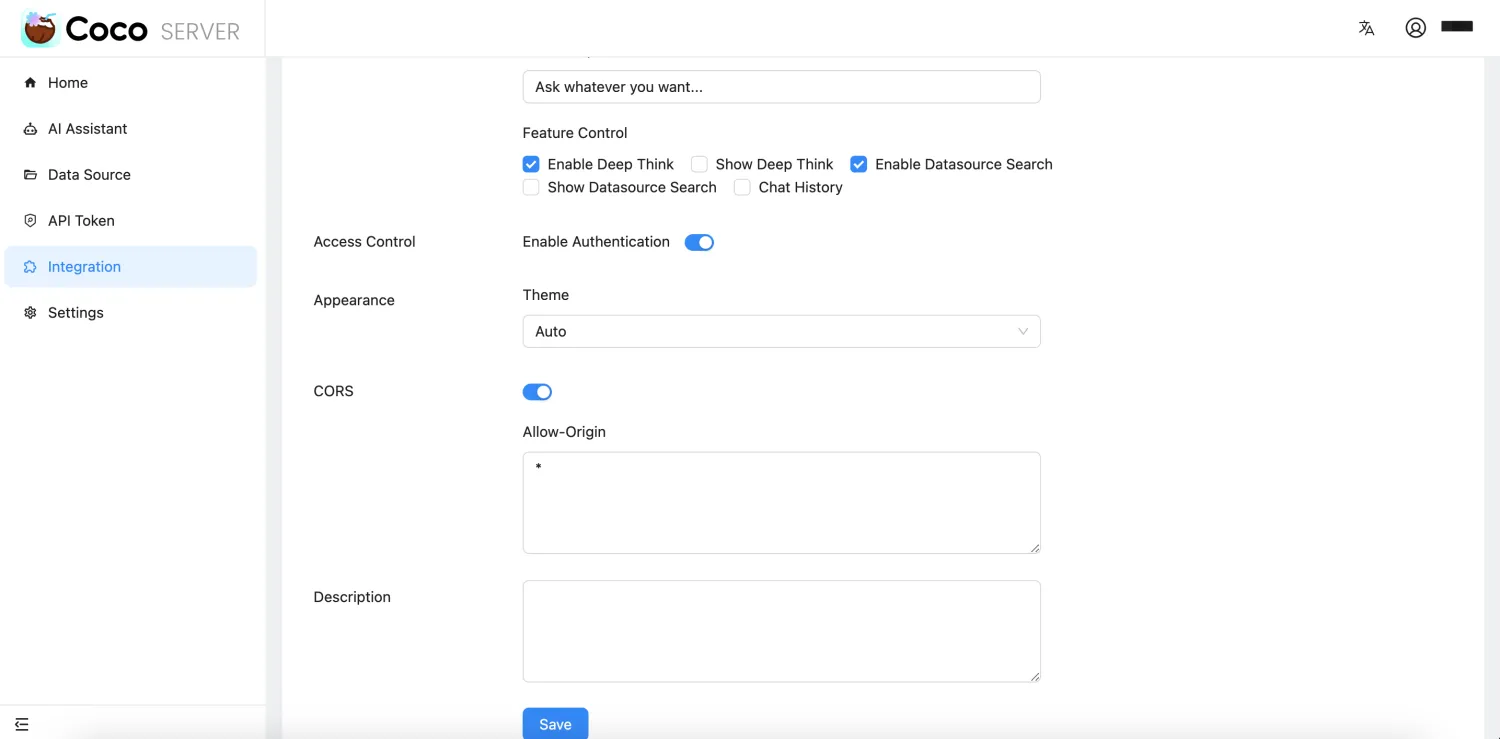

- 新增集成 CRUD 管理和 CORS 配置支持

- 新增删除附件 API

- 新增动态 JS 封装器用于小组件

- 支持在服务端解析文档图标

- 为小组件集成添加推荐主题功能

- 新增敏感字段过滤支持

问题修复

- 修复提供商信息版本问题

- 修复数据源关键词搜索过滤未按预期工作的问题

- 修复必须条件中未选中数据源条件未被移除的问题

INFINI Easysearch v1.12.0

INFINI Easysearch 是一个分布式的搜索型数据库,实现非结构化数据检索、全文检索、向量检索、地理位置信息查询、组合索引查询、多语种支持、聚合分析等。Easysearch 可以完美替代 Elasticsearch,同时添加和完善多项企业级功能。Easysearch 助您拥有简洁、高效、易用的搜索体验。

Easysearch 本次更新如下:

功能更新

AI模块持续增强中,已集成Ollama embedding API,支持文本向量化Rollup新增write_optimization配置项,启用后采用自动生成文档 ID 的策略,大幅提升写入速度Rollup现在支持针对job级别配置rollover的max docs

问题修复

Rollup修复带有内嵌的 pipeline 聚合时不能和原始索引聚合正常合并的问题

优化改进

- 优化了

rollup索引字段名长度,减小rollup job运行时的内存占用

INFINI Console v1.29.2

INFINI Console 是一款开源的非常轻量级的多集群、跨版本的搜索基础设施统一管控平台。通过对流行的搜索引擎基础设施进行跨版本、多集群的集中纳管, 企业可以快速方便的统一管理企业内部的不同版本的多套搜索集群。

Console 在线体验:

http://demo.infini.cloud (用户名/密码:readonly/readonly)。

Console 本次更新如下:

问题修复

- 修复开发工具查询长整型数据精度丢失问题

- 回滚

strict_date_optional_time去除修改,影响数据探索时间格式化

优化改进

- 优化配置中心配置自动同步时,可根据客户端实例标签进行筛选

- 优化屏幕分辨率适配,增强用户体验

INFINI Gateway v1.29.2

INFINI Gateway 是一个开源的面向搜索场景的高性能数据网关,所有请求都经过网关处理后再转发到后端的搜索业务集群。基于 INFINI Gateway 可以实现索引级别的限速限流、常见查询的缓存加速、查询请求的审计、查询结果的动态修改等等。

Gateway 本次更新如下:

优化改进

- 同步更新 Framework v1.1.5 优化了一些已知问题

INFINI Agent v1.29.2

INFINI Agent 负责采集和上传 Elasticsearch, Easysearch, Opensearch 集群的日志和指标信息,通过 INFINI Console 管理,支持主流操作系统和平台,安装包轻量且无任何外部依赖,可以快速方便地安装。

Agent 本次更新如下:

优化改进

- 同步更新 Framework v1.1.5 优化了一些已知问题

INFINI Loadgen v1.29.2

INFINI Loadgen 是一款开源的专为 Easysearch、Elasticsearch、OpenSearch 设计的轻量级性能测试工具。

Loadgen 本次更新如下:

优化改进

- 同步更新 Framework v1.1.5 优化了一些已知问题

INFINI Framework v1.1.5

INFINI Framework 是 INFINI Labs 基于 Golang 的产品的核心基础,已开源。该框架以开发者为中心设计,简化了构建高性能、可扩展且可靠的应用程序的过程。

Framework 本次更新如下:

重大变更

- 为了 Web 模块,将认证配置 (auth config) 重构为安全配置 (security config)。

功能更新

- 通用可插拔的安全特性。

- 向 UI 处理程序添加 CORS 设置。

问题修复

- 修复默认设置为绿色 (green) 时集群初始化状态丢失的问题。

优化改进

- 重构 Elasticsearch 的错误基类。

- 避免 Redis 启动期间发生 panic。

- 跳过 JSON 序列化时任务上下文中的 Cancel 操作。

- 日志记录中不包含换行符。

- 更新日志信息。

- 向 API 添加更多选项。

- 应首先执行低优先级的过滤器。

- 将权限选项 (permission options) 重构为数组。

- 添加在 InterfaceToInt 中转换浮点数的支持。

- 添加用于访问 API 特性选项的实用工具。

- 移除不必要的锁。

- 更新 API 标签以支持接口。

更多详情请查看以下详细的 Release Notes 或联系我们的技术支持团队!

- INFINI Easysearch

- INFINI Console

- INFINI Gateway

- INFINI Agent

- INFINI Loadgen

- INFINI Framework

- Coco AI App

- Coco AI Server

期待反馈

欢迎下载体验使用,如果您在使用过程中遇到如何疑问或者问题,欢迎前往 INFINI Labs Github(https://github.com/infinilabs) 中的对应项目中提交 Feature Request 或提交 Bug。

下载地址: https://infinilabs.cn/download

邮件:hello@infini.ltd

电话:(+86) 400-139-9200

Discord:https://discord.gg/4tKTMkkvVX

也欢迎大家微信扫码添加小助手(INFINI-Labs),加入用户群一起讨论交流。

关于极限科技(INFINI Labs)

极限科技,全称极限数据(北京)科技有限公司,是一家专注于实时搜索与数据分析的软件公司。旗下品牌极限实验室(INFINI Labs)致力于打造极致易用的数据探索与分析体验。

极限科技是一支年轻的团队,采用天然分布式的方式来进行远程协作,员工分布在全球各地,希望通过努力成为中国乃至全球企业大数据实时搜索分析产品的首选,为中国技术品牌输出添砖加瓦。

INFINI Labs 产品更新发布!此次更新涵盖 Coco AI 、Easysearch 等产品多项重要升级,重点提升 AI 搜索能力、易用性及企业级优化。

- Coco AI v0.3 作为 开源、跨平台的 AI 搜索工具,新增快捷键设置,支持多个聊天会话等功能。

- Coco AI Server 新增连接器 UI 管理支持,允许用户通过请求头传递 websocket 会话 ID。

- INFINI Easysearch v1.12.0 集成 AI 向量搜索,优化 Rollup 能力。

- INFINI Console、Gateway、Agent、Loadgen、Framework 关键问题修复,优化 Security 处理与整体用户体验。

Coco AI v0.3

Coco AI 是一个完全开源、跨平台的统一 AI 搜索与效率工具,能够连接并搜索多种数据源,包括应用程序、文件、谷歌网盘、Notion、语雀、Hugo 等本地与云端数据。通过接入 DeepSeek 等大模型,Coco AI 实现了智能化的个人知识库管理,注重隐私,支持私有部署,帮助用户快速、智能地访问信息。

Coco AI v0.3.0 视频演示。

Coco AI 本次详细更新记录如下:

Coco AI 客户端 v0.3.0

功能更新

- 新增快捷键设置

- 支持多个聊天会话

问题修复

- 应用程序搜索移除图标不正常的候选列表

优化改进

- 重构代码,复用前端组件提供 Web Widget 外部引入

Coco AI 服务端 v0.3.0

功能更新

- 新增连接器 UI 管理支持

- 根据数据源的启用状态控制相关文档的可搜索性

- 允许用户通过请求头传递 websocket 会话 ID

- 新增集成组件管理

- 新增搜索框小组件,便于嵌入网站

- 新增集成 CRUD 管理和 CORS 配置支持

- 新增删除附件 API

- 新增动态 JS 封装器用于小组件

- 支持在服务端解析文档图标

- 为小组件集成添加推荐主题功能

- 新增敏感字段过滤支持

问题修复

- 修复提供商信息版本问题

- 修复数据源关键词搜索过滤未按预期工作的问题

- 修复必须条件中未选中数据源条件未被移除的问题

INFINI Easysearch v1.12.0

INFINI Easysearch 是一个分布式的搜索型数据库,实现非结构化数据检索、全文检索、向量检索、地理位置信息查询、组合索引查询、多语种支持、聚合分析等。Easysearch 可以完美替代 Elasticsearch,同时添加和完善多项企业级功能。Easysearch 助您拥有简洁、高效、易用的搜索体验。

Easysearch 本次更新如下:

功能更新

AI模块持续增强中,已集成Ollama embedding API,支持文本向量化Rollup新增write_optimization配置项,启用后采用自动生成文档 ID 的策略,大幅提升写入速度Rollup现在支持针对job级别配置rollover的max docs

问题修复

Rollup修复带有内嵌的 pipeline 聚合时不能和原始索引聚合正常合并的问题

优化改进

- 优化了

rollup索引字段名长度,减小rollup job运行时的内存占用

INFINI Console v1.29.2

INFINI Console 是一款开源的非常轻量级的多集群、跨版本的搜索基础设施统一管控平台。通过对流行的搜索引擎基础设施进行跨版本、多集群的集中纳管, 企业可以快速方便的统一管理企业内部的不同版本的多套搜索集群。

Console 在线体验:

http://demo.infini.cloud (用户名/密码:readonly/readonly)。

Console 本次更新如下:

问题修复

- 修复开发工具查询长整型数据精度丢失问题

- 回滚

strict_date_optional_time去除修改,影响数据探索时间格式化

优化改进

- 优化配置中心配置自动同步时,可根据客户端实例标签进行筛选

- 优化屏幕分辨率适配,增强用户体验

INFINI Gateway v1.29.2

INFINI Gateway 是一个开源的面向搜索场景的高性能数据网关,所有请求都经过网关处理后再转发到后端的搜索业务集群。基于 INFINI Gateway 可以实现索引级别的限速限流、常见查询的缓存加速、查询请求的审计、查询结果的动态修改等等。

Gateway 本次更新如下:

优化改进

- 同步更新 Framework v1.1.5 优化了一些已知问题

INFINI Agent v1.29.2

INFINI Agent 负责采集和上传 Elasticsearch, Easysearch, Opensearch 集群的日志和指标信息,通过 INFINI Console 管理,支持主流操作系统和平台,安装包轻量且无任何外部依赖,可以快速方便地安装。

Agent 本次更新如下:

优化改进

- 同步更新 Framework v1.1.5 优化了一些已知问题

INFINI Loadgen v1.29.2

INFINI Loadgen 是一款开源的专为 Easysearch、Elasticsearch、OpenSearch 设计的轻量级性能测试工具。

Loadgen 本次更新如下:

优化改进

- 同步更新 Framework v1.1.5 优化了一些已知问题

INFINI Framework v1.1.5

INFINI Framework 是 INFINI Labs 基于 Golang 的产品的核心基础,已开源。该框架以开发者为中心设计,简化了构建高性能、可扩展且可靠的应用程序的过程。

Framework 本次更新如下:

重大变更

- 为了 Web 模块,将认证配置 (auth config) 重构为安全配置 (security config)。

功能更新

- 通用可插拔的安全特性。

- 向 UI 处理程序添加 CORS 设置。

问题修复

- 修复默认设置为绿色 (green) 时集群初始化状态丢失的问题。

优化改进

- 重构 Elasticsearch 的错误基类。

- 避免 Redis 启动期间发生 panic。

- 跳过 JSON 序列化时任务上下文中的 Cancel 操作。

- 日志记录中不包含换行符。

- 更新日志信息。

- 向 API 添加更多选项。

- 应首先执行低优先级的过滤器。

- 将权限选项 (permission options) 重构为数组。

- 添加在 InterfaceToInt 中转换浮点数的支持。

- 添加用于访问 API 特性选项的实用工具。

- 移除不必要的锁。

- 更新 API 标签以支持接口。

更多详情请查看以下详细的 Release Notes 或联系我们的技术支持团队!

- INFINI Easysearch

- INFINI Console

- INFINI Gateway

- INFINI Agent

- INFINI Loadgen

- INFINI Framework

- Coco AI App

- Coco AI Server

期待反馈

欢迎下载体验使用,如果您在使用过程中遇到如何疑问或者问题,欢迎前往 INFINI Labs Github(https://github.com/infinilabs) 中的对应项目中提交 Feature Request 或提交 Bug。

下载地址: https://infinilabs.cn/download

邮件:hello@infini.ltd

电话:(+86) 400-139-9200

Discord:https://discord.gg/4tKTMkkvVX

也欢迎大家微信扫码添加小助手(INFINI-Labs),加入用户群一起讨论交流。

关于极限科技(INFINI Labs)

极限科技,全称极限数据(北京)科技有限公司,是一家专注于实时搜索与数据分析的软件公司。旗下品牌极限实验室(INFINI Labs)致力于打造极致易用的数据探索与分析体验。

极限科技是一支年轻的团队,采用天然分布式的方式来进行远程协作,员工分布在全球各地,希望通过努力成为中国乃至全球企业大数据实时搜索分析产品的首选,为中国技术品牌输出添砖加瓦。

收起阅读 »【搜索客社区日报】第2012期 (2025-03-31)

https://infinilabs.cn/blog/202 ... ison/

2、如何使用 Grafana 连接 Easyearch

https://infinilabs.cn/blog/202 ... arch/

3、不建 Hugo、不用 Hexo,纯 Markdown 文件也能接入 Coco-AI!

https://mp.weixin.qq.com/s/Xvn1CcQqlVOREY0fSI2A4w

4、Manus的技术实现原理浅析与简单复刻

https://mp.weixin.qq.com/s/SSO-w6FF4mBm2zrXY5RzkA

5、深入解读大模型开发工具Dify--底层数据存储

https://blog.csdn.net/weixin_4 ... 37251

编辑:Muse

更多资讯:http://news.searchkit.cn

https://infinilabs.cn/blog/202 ... ison/

2、如何使用 Grafana 连接 Easyearch

https://infinilabs.cn/blog/202 ... arch/

3、不建 Hugo、不用 Hexo,纯 Markdown 文件也能接入 Coco-AI!

https://mp.weixin.qq.com/s/Xvn1CcQqlVOREY0fSI2A4w

4、Manus的技术实现原理浅析与简单复刻

https://mp.weixin.qq.com/s/SSO-w6FF4mBm2zrXY5RzkA

5、深入解读大模型开发工具Dify--底层数据存储

https://blog.csdn.net/weixin_4 ... 37251

编辑:Muse

更多资讯:http://news.searchkit.cn 收起阅读 »

【搜索客社区日报】第2011期 (2025-03-27)

https://mp.weixin.qq.com/s/6tp0Dq5vpY8j-mWuwwK87A

2.https://mp.weixin.qq.com/s/ymkLEvBJuKZW5a_bZZbC0A

https://mp.weixin.qq.com/s/ymkLEvBJuKZW5a_bZZbC0A

3.更智能的Kubernetes AI推理路由:Gateway API推理扩展

https://mp.weixin.qq.com/s/rNgcxF2WHqTO86v8YD4-eg

4.全球首款音乐推理模型Mureka O1首秀!爆改周杰伦,AI音乐进入DeepSeek时刻

https://mp.weixin.qq.com/s/5anNt3afJO1KXkE8zcY1TA

编辑:Se7en

更多资讯:http://news.searchkit.cn

https://mp.weixin.qq.com/s/6tp0Dq5vpY8j-mWuwwK87A

2.https://mp.weixin.qq.com/s/ymkLEvBJuKZW5a_bZZbC0A

https://mp.weixin.qq.com/s/ymkLEvBJuKZW5a_bZZbC0A

3.更智能的Kubernetes AI推理路由:Gateway API推理扩展

https://mp.weixin.qq.com/s/rNgcxF2WHqTO86v8YD4-eg

4.全球首款音乐推理模型Mureka O1首秀!爆改周杰伦,AI音乐进入DeepSeek时刻

https://mp.weixin.qq.com/s/5anNt3afJO1KXkE8zcY1TA

编辑:Se7en

更多资讯:http://news.searchkit.cn 收起阅读 »

活动回顾 - 第8期 搜索客 Meetup 直播活动圆满结束,《Elasticsearch 使用中的双刃剑特性》附 PPT 下载与视频回放

2025 年 03 月 26 日,由 搜索客社区和极限科技(INFINI Labs) 联合举办的第 8 期线上 Meetup 技术交流直播活动圆满结束。本期 Meetup 直播活动吸引了超过 800+ 技术爱好者观看参与,活动主要共同探讨了 Elasticsearch 的一些“双刃剑”特性以及在实际工作中更好地权衡和应对。

本期 Meetup 活动回顾

本期 Meetup 活动的分享嘉宾是 金端老师 ,他是极限科技(INFINI Labs)搜索运维专家,Elastic 官方认证工程师,搜索客社区日报编辑,他在 ES 运维使用方面具有丰富的实战经验,同时在 ES/lucene 技术原理也有比较多的深入研究。他为大家带来了主题为 《Elasticsearch 使用中的双刃剑特性》 精彩分享。

金端老师主要从 Elasticsearch 的分布式架构及其优化策略、近实时搜索与 NRT 机制、倒排索引的使用场景、聚合分析的性能优化,以及多集群管理与监控工具的使用体验等多个方向进行了特性分析以及优缺点分析,并结合了自身多年的 ES 运维实战经验为大家提出优化建议。

以下为部分 PPT 截图:

在活动的互动环节中,观众们积极提问,金端老师耐心解答了关于 Elasticsearch 的技术细节等问题。下面摘取部分问答:

问 1、8GB 堆内存,单个索引最大 30GB,设置单分片行不?

答: 8GB 内存的节点单个分片最大可设置为 30GB,分片数量建议根据 CPU 资源来定。问 2、ES 堆内外存大小对单索引分片大小有建议的设置吗?比如说 4GB 堆内存,单索引最大 50GB,建议单索引设置几个分片?

答:对于 4GB JVM 堆内存,单个索引的分片大小建议在 20GB ~ 50GB 之间。索引设置多少分片也需要看能给多少 CPU 资源,堆外缓存大小越高越好,它的数据文件能在对外的缓存里面一直保持在里面,它就能通过内存去查,保障性能。另外监控 GC 情况,如果堆内存压力大,需优化查询方式,或增加节点提升堆内存配置等。问 3、Elasticsearch 的聚合查询功能非常强大,但聚合查询可能会消耗大量资源,如何优化聚合查询以提高性能?

答:可结合场景优化聚合查询,尽量限制查询范围,例如只查询最近 7 天的数据。另外只查询必要字段,聚合时尽量减少 _source 的返回,使用 size: 0 仅返回聚合结果。还有多层嵌套聚合可能导致查询耗时过长,建议拆分查询或优化业务逻辑。对于确实很消耗资源的聚合查询可使用异步查询去维护等。问 4、公司有多套 ES 集群,版本不一样,用 Kibana 查看监控运维比较麻烦,还有什么开源工具推荐?

答:推荐使用 INFNI Console 开源工具统一管理不同版本的 ES 集群,可以便捷地进行监控和维护,并且支持告警和安全审计等功能。问 5、ES 分片数量和单分片大小应该如何平衡呢?比如我的索引总数据量非常大,我应该为了避免单个分片过大而设置上千个分片呢?

答:在设置 Elasticsearch 分片数量和单分片大小时,需要结合业务实际需求进行权衡,而不是盲目追求某个标准。例如,虽然通常建议单个分片大小控制在 20-50GB 之间,但在实际生产环境中,某些情况下 60-70GB 的分片大小仍能保持良好性能。关键在于避免长尾效应导致查询性能下降,并根据业务特性进行数据拆分,而不是单纯依赖固定的大小标准。如果分片数量过多,可能会增加管理开销;如果单分片过大,则可能影响查询性能。因此,应结合数据量、查询模式和硬件资源,动态调整分片策略以实现最佳性能。

同时,在整个直播过程中,主持人进行了多轮激动人心的抽奖活动,为参会小伙伴带来了额外的惊喜。

最后感谢大家的参与和支持,让我们共同期待下一次 搜索客 Meetup 活动带来更多的精彩内容!

本期 Meetup 的 PPT 下载

本期 PPT 下载的链接:https://searchkit.cn/slides/332

本期 Meetup 视频回放

扫码关注极限实验室视频号查看直播回放,或者扫码关注极限实验室 B 站 账号,可查看本期 Meetup 活动视频。我们也会在视频号、B 站持续更新最新技术视频,欢迎通过点赞、投币,收藏,三连来支持我们。

扫码不便?B站直达链接:https://www.bilibili.com/video/BV1TMZMYXEA7

Meetup 活动讲师招募

搜索客社区 Meetup 的成功举办,离不开社区小伙伴的热情参与。目前社区讲师招募计划也在持续进行中,我们诚挚邀请各位技术大咖、行业精英踊跃提交演讲议题,与大家分享您的经验。

讲师报名链接:http://cfp.searchkit.cn

或扫描下方二维码,立刻报名成为讲师!

Meetup 活动聚焦 AI 与搜索领域的最新动态,以及数据实时搜索分析、向量检索、技术实践与案例分析、日志分析、安全等领域的深度探讨。

我们热切期待您的精彩分享!

关于 搜索客(SearchKit)社区

搜索客社区由 Elasticsearch 中文社区进行全新的品牌升级,以新的 Slogan:“搜索人自己的社区” 为宣言。汇集搜索领域最新动态、精选干货文章、精华讨论、文档资料、翻译与版本发布等,为广大搜索领域从业者提供更为丰富便捷的学习和交流平台。社区官网:https://searchkit.cn 。

关于极限科技(INFINI Labs)

极限科技,全称极限数据(北京)科技有限公司,是一家专注于实时搜索与数据分析的软件公司。旗下品牌极限实验室(INFINI Labs)致力于打造极致易用的数据探索与分析体验。

极限科技是一支年轻的团队,采用天然分布式的方式来进行远程协作,员工分布在全球各地,希望通过努力成为中国乃至全球企业大数据实时搜索分析产品的首选,为中国技术品牌输出添砖加瓦。

2025 年 03 月 26 日,由 搜索客社区和极限科技(INFINI Labs) 联合举办的第 8 期线上 Meetup 技术交流直播活动圆满结束。本期 Meetup 直播活动吸引了超过 800+ 技术爱好者观看参与,活动主要共同探讨了 Elasticsearch 的一些“双刃剑”特性以及在实际工作中更好地权衡和应对。

本期 Meetup 活动回顾

本期 Meetup 活动的分享嘉宾是 金端老师 ,他是极限科技(INFINI Labs)搜索运维专家,Elastic 官方认证工程师,搜索客社区日报编辑,他在 ES 运维使用方面具有丰富的实战经验,同时在 ES/lucene 技术原理也有比较多的深入研究。他为大家带来了主题为 《Elasticsearch 使用中的双刃剑特性》 精彩分享。

金端老师主要从 Elasticsearch 的分布式架构及其优化策略、近实时搜索与 NRT 机制、倒排索引的使用场景、聚合分析的性能优化,以及多集群管理与监控工具的使用体验等多个方向进行了特性分析以及优缺点分析,并结合了自身多年的 ES 运维实战经验为大家提出优化建议。

以下为部分 PPT 截图:

在活动的互动环节中,观众们积极提问,金端老师耐心解答了关于 Elasticsearch 的技术细节等问题。下面摘取部分问答:

问 1、8GB 堆内存,单个索引最大 30GB,设置单分片行不?

答: 8GB 内存的节点单个分片最大可设置为 30GB,分片数量建议根据 CPU 资源来定。问 2、ES 堆内外存大小对单索引分片大小有建议的设置吗?比如说 4GB 堆内存,单索引最大 50GB,建议单索引设置几个分片?

答:对于 4GB JVM 堆内存,单个索引的分片大小建议在 20GB ~ 50GB 之间。索引设置多少分片也需要看能给多少 CPU 资源,堆外缓存大小越高越好,它的数据文件能在对外的缓存里面一直保持在里面,它就能通过内存去查,保障性能。另外监控 GC 情况,如果堆内存压力大,需优化查询方式,或增加节点提升堆内存配置等。问 3、Elasticsearch 的聚合查询功能非常强大,但聚合查询可能会消耗大量资源,如何优化聚合查询以提高性能?

答:可结合场景优化聚合查询,尽量限制查询范围,例如只查询最近 7 天的数据。另外只查询必要字段,聚合时尽量减少 _source 的返回,使用 size: 0 仅返回聚合结果。还有多层嵌套聚合可能导致查询耗时过长,建议拆分查询或优化业务逻辑。对于确实很消耗资源的聚合查询可使用异步查询去维护等。问 4、公司有多套 ES 集群,版本不一样,用 Kibana 查看监控运维比较麻烦,还有什么开源工具推荐?

答:推荐使用 INFNI Console 开源工具统一管理不同版本的 ES 集群,可以便捷地进行监控和维护,并且支持告警和安全审计等功能。问 5、ES 分片数量和单分片大小应该如何平衡呢?比如我的索引总数据量非常大,我应该为了避免单个分片过大而设置上千个分片呢?

答:在设置 Elasticsearch 分片数量和单分片大小时,需要结合业务实际需求进行权衡,而不是盲目追求某个标准。例如,虽然通常建议单个分片大小控制在 20-50GB 之间,但在实际生产环境中,某些情况下 60-70GB 的分片大小仍能保持良好性能。关键在于避免长尾效应导致查询性能下降,并根据业务特性进行数据拆分,而不是单纯依赖固定的大小标准。如果分片数量过多,可能会增加管理开销;如果单分片过大,则可能影响查询性能。因此,应结合数据量、查询模式和硬件资源,动态调整分片策略以实现最佳性能。

同时,在整个直播过程中,主持人进行了多轮激动人心的抽奖活动,为参会小伙伴带来了额外的惊喜。

最后感谢大家的参与和支持,让我们共同期待下一次 搜索客 Meetup 活动带来更多的精彩内容!

本期 Meetup 的 PPT 下载

本期 PPT 下载的链接:https://searchkit.cn/slides/332

本期 Meetup 视频回放

扫码关注极限实验室视频号查看直播回放,或者扫码关注极限实验室 B 站 账号,可查看本期 Meetup 活动视频。我们也会在视频号、B 站持续更新最新技术视频,欢迎通过点赞、投币,收藏,三连来支持我们。

扫码不便?B站直达链接:https://www.bilibili.com/video/BV1TMZMYXEA7

Meetup 活动讲师招募

搜索客社区 Meetup 的成功举办,离不开社区小伙伴的热情参与。目前社区讲师招募计划也在持续进行中,我们诚挚邀请各位技术大咖、行业精英踊跃提交演讲议题,与大家分享您的经验。

讲师报名链接:http://cfp.searchkit.cn

或扫描下方二维码,立刻报名成为讲师!

Meetup 活动聚焦 AI 与搜索领域的最新动态,以及数据实时搜索分析、向量检索、技术实践与案例分析、日志分析、安全等领域的深度探讨。

我们热切期待您的精彩分享!

关于 搜索客(SearchKit)社区

搜索客社区由 Elasticsearch 中文社区进行全新的品牌升级,以新的 Slogan:“搜索人自己的社区” 为宣言。汇集搜索领域最新动态、精选干货文章、精华讨论、文档资料、翻译与版本发布等,为广大搜索领域从业者提供更为丰富便捷的学习和交流平台。社区官网:https://searchkit.cn 。

关于极限科技(INFINI Labs)

极限科技,全称极限数据(北京)科技有限公司,是一家专注于实时搜索与数据分析的软件公司。旗下品牌极限实验室(INFINI Labs)致力于打造极致易用的数据探索与分析体验。

极限科技是一支年轻的团队,采用天然分布式的方式来进行远程协作,员工分布在全球各地,希望通过努力成为中国乃至全球企业大数据实时搜索分析产品的首选,为中国技术品牌输出添砖加瓦。

收起阅读 »【搜索客社区日报】第2010期 (2025-03-26)

https://elasticstack.blog.csdn ... 86770

2.用Elasticsearch存储图片并在Kibana中显示原创

https://cloud.tencent.com/deve ... 95009

3.向量查询辨析:kNN,ANN 以及 Disk-ANN(搭梯)

https://medium.com/%40mehmetoz ... bf73e

编辑:kin122

更多资讯:http://news.searchkit.cn

https://elasticstack.blog.csdn ... 86770

2.用Elasticsearch存储图片并在Kibana中显示原创

https://cloud.tencent.com/deve ... 95009

3.向量查询辨析:kNN,ANN 以及 Disk-ANN(搭梯)

https://medium.com/%40mehmetoz ... bf73e

编辑:kin122

更多资讯:http://news.searchkit.cn 收起阅读 »

【搜索客社区日报】第2009期 (2025-03-25)

https://medium.com/filament-ai ... d87b0

2. 在RPA里可以使用ES吗?(需要梯子)

https://medium.com/trendyol-te ... f58e0

3. 可以用nginx做ES的网关吗?(需要梯子)

https://medium.com/tech-wattpa ... a4c25

编辑:斯蒂文

更多资讯:http://news.searchkit.cn

https://medium.com/filament-ai ... d87b0

2. 在RPA里可以使用ES吗?(需要梯子)

https://medium.com/trendyol-te ... f58e0

3. 可以用nginx做ES的网关吗?(需要梯子)

https://medium.com/tech-wattpa ... a4c25

编辑:斯蒂文

更多资讯:http://news.searchkit.cn

收起阅读 »

【搜索客社区日报】第2008期 (2025-03-24)

https://infinilabs.cn/blog/202 ... arch/

2、代理 Elasticsearch 服务:INFINI Gateway VS Nginx

https://infinilabs.cn/blog/202 ... ginx/

3、Manus的技术实现原理浅析与简单复刻

https://mp.weixin.qq.com/s/SSO-w6FF4mBm2zrXY5RzkA

4、Elasticsearch:数据建模的方法与规范

https://blog.csdn.net/weixin_4 ... 86718

5、使用EDOT为你的Python、Node.js和Java应用程序进行OpenAI监控

https://mp.weixin.qq.com/s/oApfLMNbgBhr3v0uYUvNTg

编辑:Muse

更多资讯:http://news.searchkit.cn

https://infinilabs.cn/blog/202 ... arch/

2、代理 Elasticsearch 服务:INFINI Gateway VS Nginx

https://infinilabs.cn/blog/202 ... ginx/

3、Manus的技术实现原理浅析与简单复刻

https://mp.weixin.qq.com/s/SSO-w6FF4mBm2zrXY5RzkA

4、Elasticsearch:数据建模的方法与规范

https://blog.csdn.net/weixin_4 ... 86718

5、使用EDOT为你的Python、Node.js和Java应用程序进行OpenAI监控

https://mp.weixin.qq.com/s/oApfLMNbgBhr3v0uYUvNTg

编辑:Muse

更多资讯:http://news.searchkit.cn 收起阅读 »

【搜索客社区日报】第2007期 (2025-03-21)

https://mp.weixin.qq.com/s/e2xmUOpczQybkrQkEjLTwg

2、RAG-Gym: 基于过程监督的检索增强生成代理优化框架

https://blog.csdn.net/deephub/ ... 07975

3、ES 踩坑记:Set Processor 字段更新引发的 _source 污染

https://infinilabs.cn/blog/2025/setprocessor-bug/

4、【老杨玩搜索】Easysearch 向量搜索 | 从零开始实现页面搜索功能

https://www.bilibili.com/video/BV1gGCGYiER4/

5、OpenSearch 3.0 预览:GPU 加速向量搜索提升大规模数据处理效率

https://opensearch.org/blog/GP ... ntier

编辑:Fred

更多资讯:http://news.searchkit.cn

https://mp.weixin.qq.com/s/e2xmUOpczQybkrQkEjLTwg

2、RAG-Gym: 基于过程监督的检索增强生成代理优化框架

https://blog.csdn.net/deephub/ ... 07975

3、ES 踩坑记:Set Processor 字段更新引发的 _source 污染

https://infinilabs.cn/blog/2025/setprocessor-bug/

4、【老杨玩搜索】Easysearch 向量搜索 | 从零开始实现页面搜索功能

https://www.bilibili.com/video/BV1gGCGYiER4/

5、OpenSearch 3.0 预览:GPU 加速向量搜索提升大规模数据处理效率

https://opensearch.org/blog/GP ... ntier

编辑:Fred

更多资讯:http://news.searchkit.cn 收起阅读 »

【搜索客社区日报】第2006期 (2025-03-20)

https://mp.weixin.qq.com/s/i6tbSc5fspkV9qxFotZEKw

2.这个比Manus更早的AI Agent,10分钟内完成复杂任务,不只是免费平替 | 对话Flowith团队

https://mp.weixin.qq.com/s/fsgp3PX2x7RMJNxtOGERzg

3.迎接十亿级 JSON 文档挑战:GreptimeDB 性能超越 ClickHouse、VictoriaLogs 等

https://mp.weixin.qq.com/s/Z1N1wXcFgBxEDVElHlwxwg

4.通过 AIBrix 多节点部署 DeepSeek-R1 671B 模型

https://mp.weixin.qq.com/s/uCvoiVyn-rxRNGnKHw5uGw

编辑:Se7en

更多资讯:http://news.searchkit.cn

https://mp.weixin.qq.com/s/i6tbSc5fspkV9qxFotZEKw

2.这个比Manus更早的AI Agent,10分钟内完成复杂任务,不只是免费平替 | 对话Flowith团队

https://mp.weixin.qq.com/s/fsgp3PX2x7RMJNxtOGERzg

3.迎接十亿级 JSON 文档挑战:GreptimeDB 性能超越 ClickHouse、VictoriaLogs 等

https://mp.weixin.qq.com/s/Z1N1wXcFgBxEDVElHlwxwg

4.通过 AIBrix 多节点部署 DeepSeek-R1 671B 模型

https://mp.weixin.qq.com/s/uCvoiVyn-rxRNGnKHw5uGw

编辑:Se7en

更多资讯:http://news.searchkit.cn 收起阅读 »

【搜索客社区日报】第2005期 (2025-03-19)

https://mp.weixin.qq.com/s/CGmCKllk_oOOqF5JYSGWCg

2.使用 Elasticsearch 构建多模式 RAG 系统:哥谭市的故事

https://blog.csdn.net/UbuntuTo ... 95339

3.如何分析和优化 Elastic 部署的存储占用

https://cloud.tencent.com/deve ... 03038

编辑:kin122

更多资讯:http://news.searchkit.cn

https://mp.weixin.qq.com/s/CGmCKllk_oOOqF5JYSGWCg

2.使用 Elasticsearch 构建多模式 RAG 系统:哥谭市的故事

https://blog.csdn.net/UbuntuTo ... 95339

3.如何分析和优化 Elastic 部署的存储占用

https://cloud.tencent.com/deve ... 03038

编辑:kin122

更多资讯:http://news.searchkit.cn 收起阅读 »