社区日报 第852期 (2020-02-14)

http://t.cn/A6ht3QEo

2、Elasticsearch的分片管理策略

http://t.cn/A6htuc3Q

3、Elastic官方学习视频

http://t.cn/A6htuffz

编辑:铭毅天下

归档:https://ela.st/cn-daily-all

订阅:https://ela.st/cn-daily-sub

沙龙:https://ela.st/cn-meetup

http://t.cn/A6ht3QEo

2、Elasticsearch的分片管理策略

http://t.cn/A6htuc3Q

3、Elastic官方学习视频

http://t.cn/A6htuffz

编辑:铭毅天下

归档:https://ela.st/cn-daily-all

订阅:https://ela.st/cn-daily-sub

沙龙:https://ela.st/cn-meetup

收起阅读 »

社区日报 第851期 (2020-02-13)

http://t.cn/A6PFwYtF

2、优雅处理海量日志,腾讯万亿级 Elasticsearch 技术实战

http://t.cn/A6h4gqi3

3、Filebeat+Kafka+ELK分布式日志收集

http://t.cn/A6h4gfVw

编辑:江水

归档:https://ela.st/cn-daily-all

订阅:https://ela.st/cn-daily-sub

沙龙:https://ela.st/cn-meetup

http://t.cn/A6PFwYtF

2、优雅处理海量日志,腾讯万亿级 Elasticsearch 技术实战

http://t.cn/A6h4gqi3

3、Filebeat+Kafka+ELK分布式日志收集

http://t.cn/A6h4gfVw

编辑:江水

归档:https://ela.st/cn-daily-all

订阅:https://ela.st/cn-daily-sub

沙龙:https://ela.st/cn-meetup

收起阅读 »

社区日报 第850期 (2020-02-12)

http://t.cn/A6hLYSM7

2.ElasticSearch之映射常用操作

http://t.cn/A6hLYJkl

3.Elasticsearch 避坑指南及面试常见问题

http://t.cn/A6hLY6r3

编辑:金桥

归档:https://ela.st/cn-daily-all

订阅:https://ela.st/cn-daily-sub

沙龙:https://ela.st/cn-meetup

http://t.cn/A6hLYSM7

2.ElasticSearch之映射常用操作

http://t.cn/A6hLYJkl

3.Elasticsearch 避坑指南及面试常见问题

http://t.cn/A6hLY6r3

编辑:金桥

归档:https://ela.st/cn-daily-all

订阅:https://ela.st/cn-daily-sub

沙龙:https://ela.st/cn-meetup 收起阅读 »

社区日报 第849期 (2020-02-11)

http://t.cn/A6hwXq52

2、公司银子不多,遇到Elasticsearch OOM(内存溢出),除了瞪白眼,还能干啥...

http://t.cn/A6hwXMnL

3、Splunk 用户迁移到 ELK 技术指南

http://t.cn/A6hwXY49

编辑:rockybean

归档:https://ela.st/cn-daily-all

订阅:https://ela.st/cn-daily-sub

沙龙:https://ela.st/cn-meetup

http://t.cn/A6hwXq52

2、公司银子不多,遇到Elasticsearch OOM(内存溢出),除了瞪白眼,还能干啥...

http://t.cn/A6hwXMnL

3、Splunk 用户迁移到 ELK 技术指南

http://t.cn/A6hwXY49

编辑:rockybean

归档:https://ela.st/cn-daily-all

订阅:https://ela.st/cn-daily-sub

沙龙:https://ela.st/cn-meetup 收起阅读 »

社区日报 第848期 (2020-02-10)

http://t.cn/A6h7Ngdo

2、Springboot + ElasticSearch 构建博客检索系统

http://t.cn/A6h7Nkty

3、prometheus 监控ElasticSearch核心指标

http://t.cn/A6h7NskY

编辑:铭毅天下

归档:https://ela.st/cn-daily-all

订阅:https://ela.st/cn-daily-sub

沙龙:https://ela.st/cn-meetup

http://t.cn/A6h7Ngdo

2、Springboot + ElasticSearch 构建博客检索系统

http://t.cn/A6h7Nkty

3、prometheus 监控ElasticSearch核心指标

http://t.cn/A6h7NskY

编辑:铭毅天下

归档:https://ela.st/cn-daily-all

订阅:https://ela.st/cn-daily-sub

沙龙:https://ela.st/cn-meetup

收起阅读 »

潜心一技、做到极致!——Elastic认证工程师之路

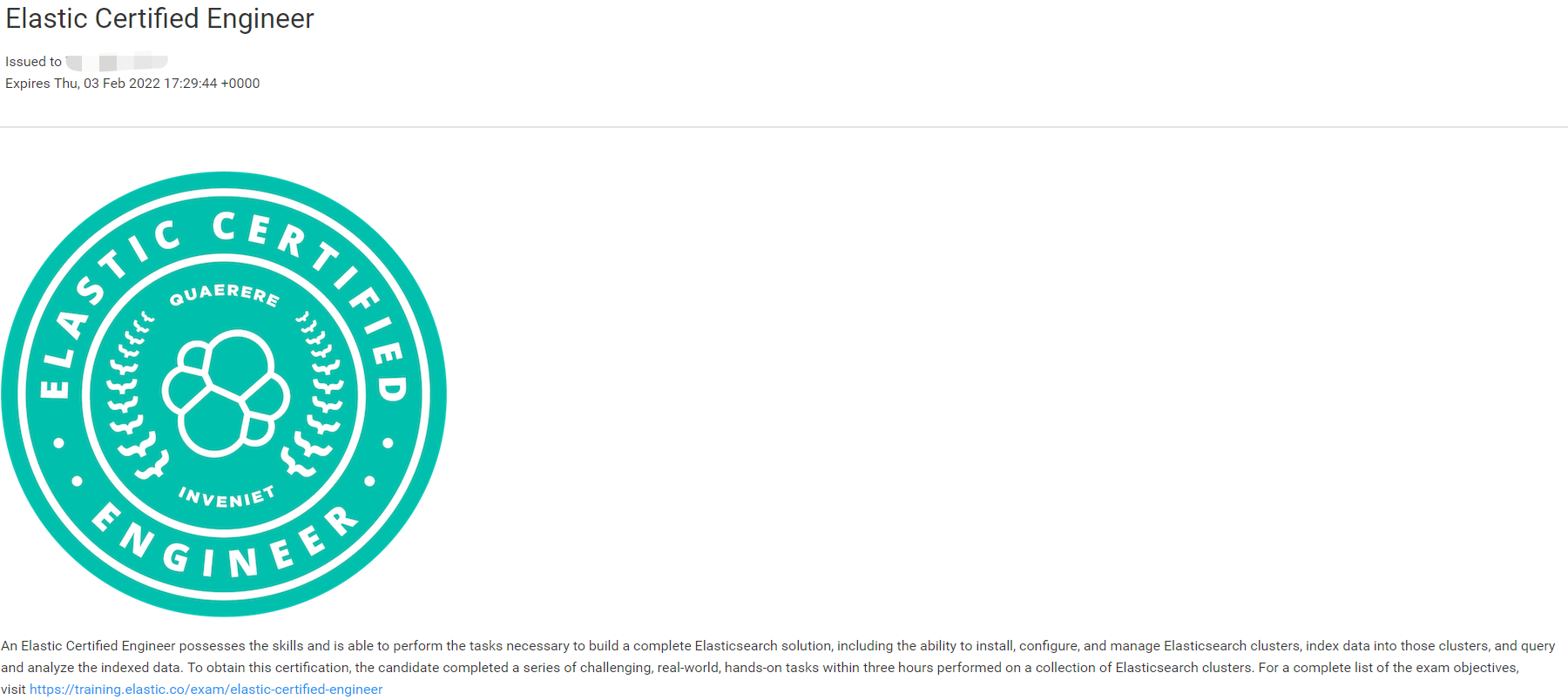

2020年2月3日我参加Elastic认证工程师考试,2020年2月5日中午得到认证结果:通过考试。

趁热打铁,将Elastic认证工程师考试相关内容、经验教训等和盘而出,希望对后续参加考试的同学有所帮助。

1、Elastic工程师有什么用?

An Elastic Certified Engineer possesses the skills and is able to perform the tasks necessary to build a complete Elasticsearch solution, including the ability to install, configure, and manage Elasticsearch clusters, index data into those clusters, and query and analyze the indexed data. To obtain this certification, the candidate completed a series of challenging, real-world, hands-on tasks within three hours performed on a collection of Elasticsearch clusters.

通过后,授予的徽章下方会有如上一段话。

Elastic认证工程师拥有构建完整的Elasticsearch解决方案的技能。包含:包括部署、配置和管理Elasticsearch集群;将数据索引到这些集群中以及查询和分析索引数据的能力。 为了获得此认证,候选人在三个小时内在多个Elasticsearch集群实战完成了一系列具有挑战性的实任务。

2、中国有多少人考过了这个考试?

截止2019年12月7日,中国的Elastic认证工程师只有21位。全球:550位。

我在参加大会后晚上的总结文章中提到:

- 很震撼、很稀缺。

- 思考:从经济学角度,稀缺就意味着贵;同时稀缺也意味着机会!

3、我为什么要考?

我非常喜欢赢在中国的主题曲“在路上”(刘欢演唱、张瑞敏 /王利芬等作词)。

"那一天, 我不得已上路

为不安分的心, 为自尊的生存

为自我的证明......“。

这首歌是创业者的励志歌曲,对学生、上班族同样适用。

不知道你是否和我一样,在人生的道路上,或多或少总有那么几个人说不行。

- 你上学时,他说你学习不行;

- 你工作了,他说你技术不行;

- 你搞ES了,他说你水平不行;

- 你写博客了,他说你是嘴炮;

- 你负责产品了,他说你协调不行;

- 你带团队了,他说你管理不行; ......

最好的办法,就是不理会外界的看法,做好自己认为对的东西、坚持自己的坚持!

但除了不理会,我更会以以下的方式激励自己:

1949年9月21日,伟大领袖毛主席在中国人民政治协商会议第一次全体会议上发表的开幕词中提到:

- 让那些内外反动派在我们面前发抖吧!

- 让他们去说我们这也不行那也不行吧!

- 中国人民的不屈不挠的努力。

- 必将稳步地达到自己的目的。

考取Elastic认证考试不为别的,就是为了证明自己!

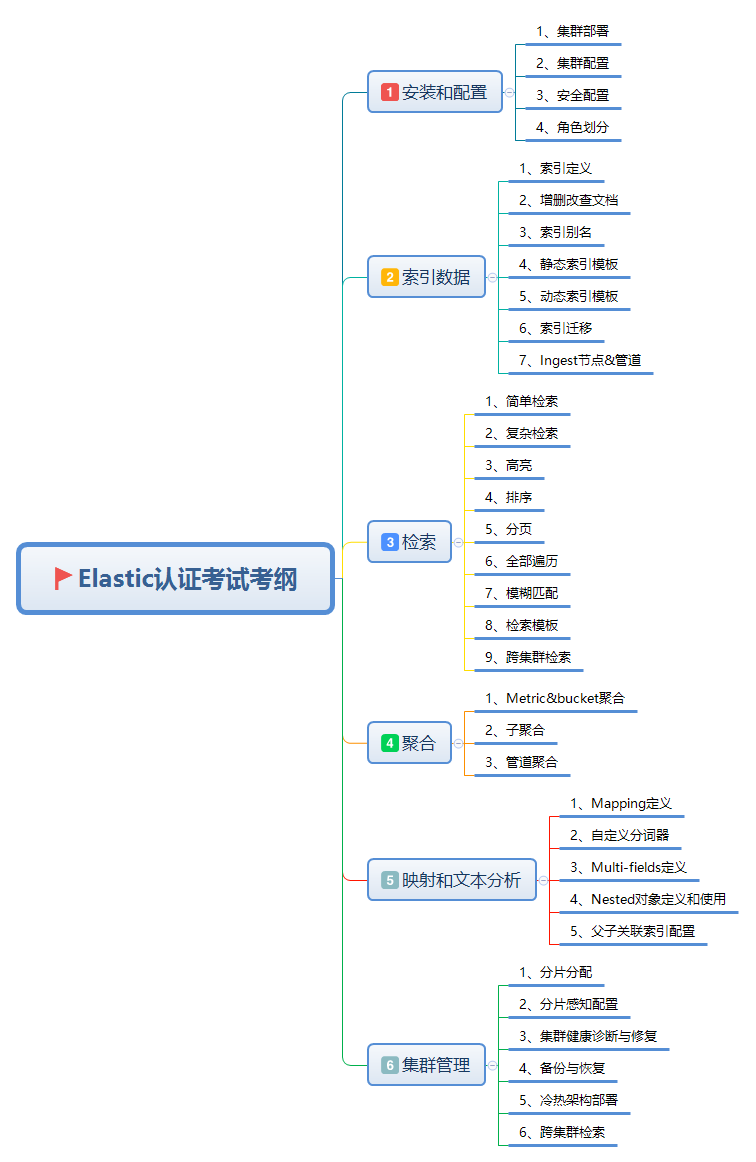

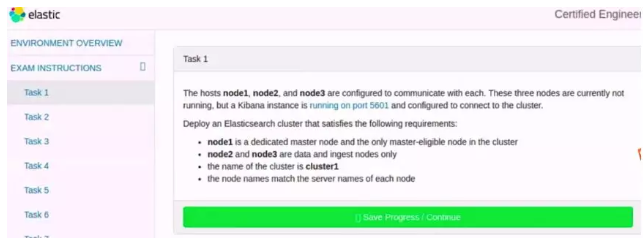

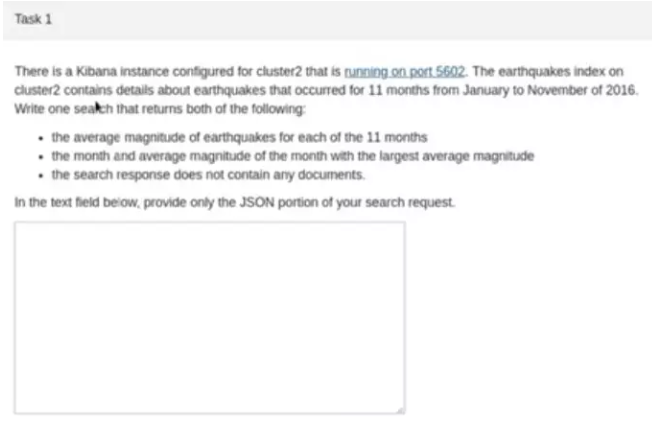

4、Elasticsearch认证考什么?

一图胜千言。

5、怎么准备Elastic认证考试?

5.1 站在巨人的肩上

先别着急上手,先做足提前工作,看看别人是如何通过的?

一定要有全球视野,国内通过经验分享,线上的有:wood大叔、魏彬老师(中国第一位)、阮一鸣老师、腾讯云慕容兄、XX快运的一技术大佬等。

线下的有杭州站的一次meetup分享、2019开发者大会的7位大佬的面对面交流分享。

国外的论坛、社区、博客等也有很多分享,要一并关注。

别人的宝贵的经验、教训能节省我们不少时间。

举例1:做足考试前的准备工作。

- 考试的书桌或者办公桌要除了电脑、键盘、鼠标外没有任何其他物品。

- 如果是笔记本电脑,不要有外接显示器。

- 准备有包含和自己注册考试名字拼音一致的证件(护照或港澳通行证),身份证需要提前邮件申请报备才可以。

- 提前检查摄像头确保好使,考试期间摄像头要全程打开、桌面要全程共享。 提前做足准备,避免考试的时候忙乱,影响考试节奏。

举例2:15分钟的检查环节,通过chat对话框进行,对方全是英文。

应试者是可以发中文的。 这是开发者大会听到的经验。我考试直接用上了,英文敲的毕竟有点费劲,对方不懂中文,但是有谷歌翻译,一样保证可以顺畅的沟通。 主要是节省宝贵的考试时间。

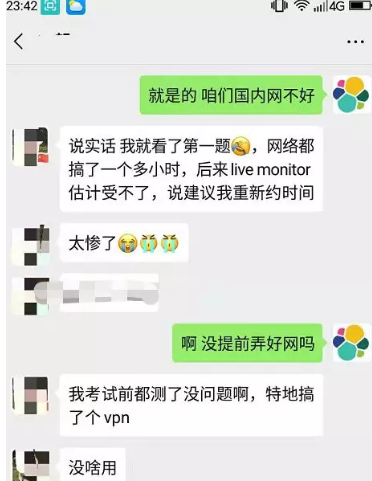

举例3:提前准备好VPN。

网络不通,复习的再好也会有很大的挫败感。 我自己考试提前准备了vpn,但考到一半,vpn出故障,直接本地网络连接的,那个卡啊,苦的一逼,直接掉线5次+。

5.2 熟悉考纲

明白不考什么、考什么很重要。

大家都知道:Elastic公司发展迅猛,早已由单个的Elasticsearch发展为ELK Stack。

包含但不限于:Elasticsearch、kibana、logstash、beats等。

但,Elasticsearch认证考试只考Elasticsearch,不考logstash、beats、kibana等。

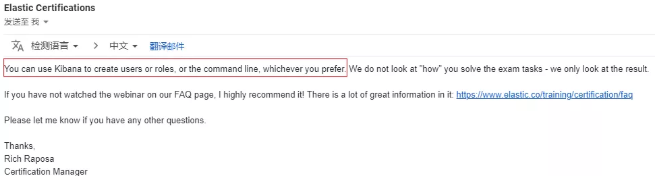

kibana还得算个例外,基于xpack构建多用户、权限设置可以命令行实现,但通过kibana更快捷,考试可不可以直接kibana操作呢。

这个问题,我提前做了邮件咨询、回复如下:

要熟悉到什么程度呢? 对着考纲,把要考的知识点分布的官方文档的位置,能O(1)时间找出来。

5.3 刻意学习Elastic官方文档

单纯的看文档的确很枯燥、容易困,所以,要刻意练习。

如何刻意学习?

5.3.1 搭建有随手可得的集群环境。

- 方式一:本机docker集群(三节点)。

- 方式二:买云服务器。 我是买的云服务器,2核4GB,最多部署二个节点。足够,很多多节点任务,2节点演练也可以。

不建议:本地windows环境搭建集群。

原因:考试时centos7的环境。windows和linux毕竟不完全一致。

要模拟,就是近实战环境模拟。

5.3.2 平时遇到任何Elastic问题,先从文档找答案。

-

1、考试环境是7.2版本,默认最新7.5+,需要切换下版本。 版本不一样,文档结构是不一样的。

- 2、刻意熟悉文档。 注意:考试除了官方文档,不允许google等任何第三方文档的。

遇到问题,通过google、stackoverflow、elastic论坛找答案固然很快, 但,这样少了一次熟悉文档的机会。

- 3、官方文档支持搜索,但万不得已,不建议用。

原因1:官方文档的搜索不好用。

原因2:熟悉文档结构后,直接锁定目标比搜索要快很多。

5.3.3 一定要动手敲

一定要动手敲!一定要动手敲!一定要动手敲! 重要的事情说三遍!

看一遍,不等于理解了。

理解了,不等于会实战了。

只有实战+理解了,考试才有信息和把握。

考试时kibana环境,平时:head插件、cerebro、postman都可以配置集群。

但,我们从平时就使用kibana dev-tool实现。

做到:平时如考试、考试如平时。

5.4 熟悉考试题型

不考:选择题、填空题、问答题、原理题。

全部都是英文实战题。

- 题型一、实战部署题。

举例:冷热集群架构部署。

- 题型二、实战DSL题。

举例:满足给定条件的自定义模板、自定义查询、聚合、reindex+script等。

6、Elastic认证经验、教训

6.1 备好vpn

血淋淋教训告诉你:如果条件允许,建议备两套美国线路的vpn。

我自己深有体会,网络不好,自己会着急,很无助但没有任何解决办法。

所以,工作要做在平时。

6.2 不打无准备之仗

按照考纲、考点刷文档、通过kibana实践。

考试试题中规中矩,没有很复杂的难题,但切记要做最充分的准备。

确保每个知识点自己kibana都敲过3遍以上。

部分点如:批量写入文档、查询、聚合、自定义Mapping常规操作,建议熟悉到不用翻文档,直接能敲出来。

6.3 盲点、疑点可能就是考点

不要有知识盲区,因为:任何你的知识盲区,都可能是考点。

把工作做在平时,模棱两可的点,提前识别到,提前解决了,考试就剩下: 复制、黏贴、修改、提交过程了。

举例:上文提到的基于kibana配置用户角色。

举例:most_fields, best_fields, cross_fileld的核心区别?

6.4 考试常规技巧依然适用

- 第一:进入考试环境后,先看一下有几个集群。

我考试时候是4个集群,1个四节点,其他3个单节点。

因为:集群环境是你后面所有操作的前置条件。

- 第二:通读一遍考题。 目的1:是识别一下,哪些自己熟悉、哪些不熟悉。

建议:先易后难、先简后繁。

目的2:知道哪些单节点环境,哪些多节点。

建议:先搞定单节点的,多节点集群的留到最后。

- 第三:会多少,写多少。

我猜测考试会按点给分的,最后给出一个考试过的线(待核实)。

但,空着肯定是不行的。

7、Elastic认证常见问题

征集了一些大家最关心问题,梳理总结如下。

7.1 我英语太烂了,看不懂考题怎么办?

第一:英语四级就基本没问题能看懂题目,没有六级、考研的长难句,都是中规中矩试题,不复杂。

第二:平时看文档尝试关掉翻译。

第三:去年开发者大会,有个分享嘉宾说他考试时候开了谷歌翻译,也过了。

第三点没有求证,我建议可以发个邮件给考试组问一下,如果允许那就更好了,避免了理解歧义导致实战出错。

7.2 试错成本太高了,400美金肉疼,怎么办?

的确,真心肉疼。

提醒:多关注一下官方的活动。

- 活动一:买一赠一活动。

也就是说:购买一次考试,赠送一次补考机会,补考1年内有效。

- 活动二:75折扣活动。

去年下半年截至2020年1月31日有75折活动,能省100美金。

所以,做好充分准备争取一次过很重要。

7.3 认证考试有题库吗?

官方没有提供。

不过国内阮一鸣老师做了总结、国外一德国博士也做了总结。

我都做了一遍并梳理出答案。欢迎留言交流。

7.4 很难考吗?

有一定难度。体现在两个层面。

- 第一:好多考点,平时我们不见得常用。

举例:自定义分析部分的同义词synonym filter、跨集群搜索、多机架分片均衡分配。

- 第二:考试多少会设置一点点障碍。

我本次考试的4个集群全都没有启动,需要自己按条件部署后启动。

- 第三:考试时间3个小时。

10-12道题,在熟悉文档的前提下,每个题目都需要争分夺秒、分秒必争。

7.5 考取认证有什么用?

第一:Elastic总部官方认可。

来自Elastic官方的认可,不容小觑。是对你实践能力的认可。

第二:含金量高。

-

Elastic官方、社区大佬wood大叔、极客时间阮一鸣老师都强调过这个证书含金量很高。

- 他不同于工信部的软考、PMP考试考的是理论能力、理解能力,全国每年几万人甚至十几万人都能通过,甚至在校大学生背背也能通过,

Elastic认证没有实践过几乎100%通不过的。

第三:“升职加薪”。

- 如果你考虑换工作,可以作为很好的敲门砖。

- 如果你是面试官,应聘者通过认证,基础的Elastic实战问题说明已经非常熟练了,极大的提高你的招聘质量。

- 如果你是职场人士或在校学生族,熟悉考点的过程也是你加强Elastic认知的过程。

最强大脑Dr魏在得到的课程中提到:"认知科学成果表明,提取记忆过程,特别是用考试作为手段的提取方式,不仅有学习的作用,甚至比简单的重复学习效果更好。”

7.6 一次通过的吗?

很遗憾,我也不是一次性通过的。

-

2019年7月份考过一次,当时只简单过了一遍文档,很多地方没有实际敲过,考试一紧张,11道题只完成8道。 没过总结的原因无非两字:不熟。其他都是借口。

- 2019年12月7日参加完Elastic开发者大会后,很有触动,又开始重新准备考试,侧重实战。

7.7 有没有可参考的复习计划?

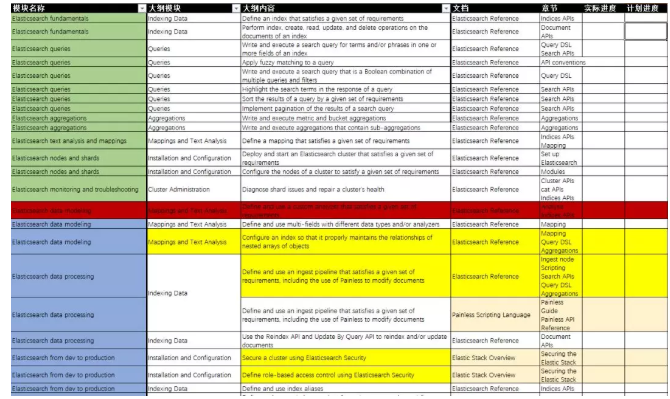

2019年下半年,杭州的一次meetup分享很受用,我按照他的表格做了知识点的梳理和大致实践规划。

大致分三个阶段。

- 阶段1:熟悉官方文档。

官方文档+案例敲一遍,相关数据可以使用kibana提供的3种数据集。

这个时候遇到的任何问题自己解决不了,都可以抛出来中英文社区讨论,直到彻底懂了。

- 阶段2:真题模拟,记录不熟的知识点。

我记录的一些核心点如下:

(1)parent/child

(2)nested

(3)script+ingest pipeline

(4)function_score

(5)dis_max, multi_fields(cross fields, most_fields, best_fields)

(6)security+role

(7)search template

(8)cross cluster search

(10)custom analyzer

(11)shard allocation

(12)cluster diagnose

(13)backup restore

(14)hot-ware deployment

(15)mapping muti-fields

(16)settings+analyzer+

(17)update+search+reindex script

(18) template+alias- 阶段3:查缺补漏,重点突击。

基础已经基本熟悉了,对于第二阶段发现的问题,细节再过一遍文档,查缺补漏,确保万无一失。

- 阶段4:迎战考试。

快速翻文档和1-3环节技术点,多过几遍。能o(1)时间找到文档位置。

以上三个过程,全环节都需要实战演练。

1-3阶段可以放慢速度,求稳、求准。

第4阶段适度进展,迎战考试,确保没有遗漏,确保能最快时间定位文档。

7.8 这次考了哪些题?

1、terms聚合分析

2、跨集群检索

3、4节点跨集群分片副本感知分配

5、用户角色、用户名密码指定

6、动态模板template

7、reindex+ingest pipeline

8、检索+提升评分权重

9、自定义mapping+multi-fields

10、检索+排序+高亮+等

这次考试好几个题目的题干都很长。

7.9 你考试花了多长时间?

- 2019年12月8日重新定下目标考试,2020年2月3日参加考试。

- 期间只有晚上10点到12点左右有时间。临考前2天准备了2个整天。

- 中间有别的事情+春节,断过几天。

7.10 平时工作那么忙、哪有时间考试?

- 的确,这是大家通病。年底都忙,过年也忙。

- 自己挤时间,我为了准备考试,12月8日——2月5日,朋友圈彻底关闭、一切新闻客户端彻底删除。不狠一把,你都不知道自己有多厉害!

- 期间也有想放弃的时候,就听一下俞敏洪一分钟励志演讲,管用!新东方的励志语录也萦绕在耳边“坚持下去不是因为我很坚强,而是我别无选择”。

- 特殊期间,正是提升内功的绝佳时机。看别的只会让你焦虑和恐慌,做好自己就是对国家的贡献。

- 如果你平时工作中就一直使用Elasticsearch,可以平时的时候刻意注意熟悉实践文档。我看腾讯大佬们的分享都很轻松,不用我写的这么“悲壮”。

8、考过了就牛逼了吗?

大错特错,考试说白了只能证明你文档熟+实践能力强。 并不能说明你底层原理熟悉+源码熟悉,离大佬还差十万八千里。 真正的大佬是:

- 以medcl等大佬为代表的Elastic原厂技术团队;

- 以wood大佬+阮一鸣等大佬为代表的大厂企业级实战派;

- 以魏彬等大佬为代表的咨询专家团队;

- 以张超等大佬为代表的源码原理派。

多向他们学习和求经,能获益良多。

9、小结

著名相声表演艺术家常宝华曾这样评价侯宝林大师:“在他面前,我就像不会(说相声)似的”。

我认为这句话对技术人员一样受用。技术的道路上,我们要谨记这句话。

-

一方面:新技术层出不穷,不要抱残守缺,要拥抱变化。同时注意底层原理大多是相通的,要深挖,不要浮于表面。

- 另一方面:保持对技术的敬畏和好奇之心,热爱自己的热爱、坚持自己的坚持。

专研技术的同时要多向身边或者网上的牛人学习。一个人可能走得更快,但一群人走得更远。

文章标题的来源自偶像俞敏洪老师公众号对粉丝的回复:

和大家共勉!

潜心一技、做到极致。

和你一起,死磕Elastic!

2020年2月3日我参加Elastic认证工程师考试,2020年2月5日中午得到认证结果:通过考试。

趁热打铁,将Elastic认证工程师考试相关内容、经验教训等和盘而出,希望对后续参加考试的同学有所帮助。

1、Elastic工程师有什么用?

An Elastic Certified Engineer possesses the skills and is able to perform the tasks necessary to build a complete Elasticsearch solution, including the ability to install, configure, and manage Elasticsearch clusters, index data into those clusters, and query and analyze the indexed data. To obtain this certification, the candidate completed a series of challenging, real-world, hands-on tasks within three hours performed on a collection of Elasticsearch clusters.

通过后,授予的徽章下方会有如上一段话。

Elastic认证工程师拥有构建完整的Elasticsearch解决方案的技能。包含:包括部署、配置和管理Elasticsearch集群;将数据索引到这些集群中以及查询和分析索引数据的能力。 为了获得此认证,候选人在三个小时内在多个Elasticsearch集群实战完成了一系列具有挑战性的实任务。

2、中国有多少人考过了这个考试?

截止2019年12月7日,中国的Elastic认证工程师只有21位。全球:550位。

我在参加大会后晚上的总结文章中提到:

- 很震撼、很稀缺。

- 思考:从经济学角度,稀缺就意味着贵;同时稀缺也意味着机会!

3、我为什么要考?

我非常喜欢赢在中国的主题曲“在路上”(刘欢演唱、张瑞敏 /王利芬等作词)。

"那一天, 我不得已上路

为不安分的心, 为自尊的生存

为自我的证明......“。

这首歌是创业者的励志歌曲,对学生、上班族同样适用。

不知道你是否和我一样,在人生的道路上,或多或少总有那么几个人说不行。

- 你上学时,他说你学习不行;

- 你工作了,他说你技术不行;

- 你搞ES了,他说你水平不行;

- 你写博客了,他说你是嘴炮;

- 你负责产品了,他说你协调不行;

- 你带团队了,他说你管理不行; ......

最好的办法,就是不理会外界的看法,做好自己认为对的东西、坚持自己的坚持!

但除了不理会,我更会以以下的方式激励自己:

1949年9月21日,伟大领袖毛主席在中国人民政治协商会议第一次全体会议上发表的开幕词中提到:

- 让那些内外反动派在我们面前发抖吧!

- 让他们去说我们这也不行那也不行吧!

- 中国人民的不屈不挠的努力。

- 必将稳步地达到自己的目的。

考取Elastic认证考试不为别的,就是为了证明自己!

4、Elasticsearch认证考什么?

一图胜千言。

5、怎么准备Elastic认证考试?

5.1 站在巨人的肩上

先别着急上手,先做足提前工作,看看别人是如何通过的?

一定要有全球视野,国内通过经验分享,线上的有:wood大叔、魏彬老师(中国第一位)、阮一鸣老师、腾讯云慕容兄、XX快运的一技术大佬等。

线下的有杭州站的一次meetup分享、2019开发者大会的7位大佬的面对面交流分享。

国外的论坛、社区、博客等也有很多分享,要一并关注。

别人的宝贵的经验、教训能节省我们不少时间。

举例1:做足考试前的准备工作。

- 考试的书桌或者办公桌要除了电脑、键盘、鼠标外没有任何其他物品。

- 如果是笔记本电脑,不要有外接显示器。

- 准备有包含和自己注册考试名字拼音一致的证件(护照或港澳通行证),身份证需要提前邮件申请报备才可以。

- 提前检查摄像头确保好使,考试期间摄像头要全程打开、桌面要全程共享。 提前做足准备,避免考试的时候忙乱,影响考试节奏。

举例2:15分钟的检查环节,通过chat对话框进行,对方全是英文。

应试者是可以发中文的。 这是开发者大会听到的经验。我考试直接用上了,英文敲的毕竟有点费劲,对方不懂中文,但是有谷歌翻译,一样保证可以顺畅的沟通。 主要是节省宝贵的考试时间。

举例3:提前准备好VPN。

网络不通,复习的再好也会有很大的挫败感。 我自己考试提前准备了vpn,但考到一半,vpn出故障,直接本地网络连接的,那个卡啊,苦的一逼,直接掉线5次+。

5.2 熟悉考纲

明白不考什么、考什么很重要。

大家都知道:Elastic公司发展迅猛,早已由单个的Elasticsearch发展为ELK Stack。

包含但不限于:Elasticsearch、kibana、logstash、beats等。

但,Elasticsearch认证考试只考Elasticsearch,不考logstash、beats、kibana等。

kibana还得算个例外,基于xpack构建多用户、权限设置可以命令行实现,但通过kibana更快捷,考试可不可以直接kibana操作呢。

这个问题,我提前做了邮件咨询、回复如下:

要熟悉到什么程度呢? 对着考纲,把要考的知识点分布的官方文档的位置,能O(1)时间找出来。

5.3 刻意学习Elastic官方文档

单纯的看文档的确很枯燥、容易困,所以,要刻意练习。

如何刻意学习?

5.3.1 搭建有随手可得的集群环境。

- 方式一:本机docker集群(三节点)。

- 方式二:买云服务器。 我是买的云服务器,2核4GB,最多部署二个节点。足够,很多多节点任务,2节点演练也可以。

不建议:本地windows环境搭建集群。

原因:考试时centos7的环境。windows和linux毕竟不完全一致。

要模拟,就是近实战环境模拟。

5.3.2 平时遇到任何Elastic问题,先从文档找答案。

-

1、考试环境是7.2版本,默认最新7.5+,需要切换下版本。 版本不一样,文档结构是不一样的。

- 2、刻意熟悉文档。 注意:考试除了官方文档,不允许google等任何第三方文档的。

遇到问题,通过google、stackoverflow、elastic论坛找答案固然很快, 但,这样少了一次熟悉文档的机会。

- 3、官方文档支持搜索,但万不得已,不建议用。

原因1:官方文档的搜索不好用。

原因2:熟悉文档结构后,直接锁定目标比搜索要快很多。

5.3.3 一定要动手敲

一定要动手敲!一定要动手敲!一定要动手敲! 重要的事情说三遍!

看一遍,不等于理解了。

理解了,不等于会实战了。

只有实战+理解了,考试才有信息和把握。

考试时kibana环境,平时:head插件、cerebro、postman都可以配置集群。

但,我们从平时就使用kibana dev-tool实现。

做到:平时如考试、考试如平时。

5.4 熟悉考试题型

不考:选择题、填空题、问答题、原理题。

全部都是英文实战题。

- 题型一、实战部署题。

举例:冷热集群架构部署。

- 题型二、实战DSL题。

举例:满足给定条件的自定义模板、自定义查询、聚合、reindex+script等。

6、Elastic认证经验、教训

6.1 备好vpn

血淋淋教训告诉你:如果条件允许,建议备两套美国线路的vpn。

我自己深有体会,网络不好,自己会着急,很无助但没有任何解决办法。

所以,工作要做在平时。

6.2 不打无准备之仗

按照考纲、考点刷文档、通过kibana实践。

考试试题中规中矩,没有很复杂的难题,但切记要做最充分的准备。

确保每个知识点自己kibana都敲过3遍以上。

部分点如:批量写入文档、查询、聚合、自定义Mapping常规操作,建议熟悉到不用翻文档,直接能敲出来。

6.3 盲点、疑点可能就是考点

不要有知识盲区,因为:任何你的知识盲区,都可能是考点。

把工作做在平时,模棱两可的点,提前识别到,提前解决了,考试就剩下: 复制、黏贴、修改、提交过程了。

举例:上文提到的基于kibana配置用户角色。

举例:most_fields, best_fields, cross_fileld的核心区别?

6.4 考试常规技巧依然适用

- 第一:进入考试环境后,先看一下有几个集群。

我考试时候是4个集群,1个四节点,其他3个单节点。

因为:集群环境是你后面所有操作的前置条件。

- 第二:通读一遍考题。 目的1:是识别一下,哪些自己熟悉、哪些不熟悉。

建议:先易后难、先简后繁。

目的2:知道哪些单节点环境,哪些多节点。

建议:先搞定单节点的,多节点集群的留到最后。

- 第三:会多少,写多少。

我猜测考试会按点给分的,最后给出一个考试过的线(待核实)。

但,空着肯定是不行的。

7、Elastic认证常见问题

征集了一些大家最关心问题,梳理总结如下。

7.1 我英语太烂了,看不懂考题怎么办?

第一:英语四级就基本没问题能看懂题目,没有六级、考研的长难句,都是中规中矩试题,不复杂。

第二:平时看文档尝试关掉翻译。

第三:去年开发者大会,有个分享嘉宾说他考试时候开了谷歌翻译,也过了。

第三点没有求证,我建议可以发个邮件给考试组问一下,如果允许那就更好了,避免了理解歧义导致实战出错。

7.2 试错成本太高了,400美金肉疼,怎么办?

的确,真心肉疼。

提醒:多关注一下官方的活动。

- 活动一:买一赠一活动。

也就是说:购买一次考试,赠送一次补考机会,补考1年内有效。

- 活动二:75折扣活动。

去年下半年截至2020年1月31日有75折活动,能省100美金。

所以,做好充分准备争取一次过很重要。

7.3 认证考试有题库吗?

官方没有提供。

不过国内阮一鸣老师做了总结、国外一德国博士也做了总结。

我都做了一遍并梳理出答案。欢迎留言交流。

7.4 很难考吗?

有一定难度。体现在两个层面。

- 第一:好多考点,平时我们不见得常用。

举例:自定义分析部分的同义词synonym filter、跨集群搜索、多机架分片均衡分配。

- 第二:考试多少会设置一点点障碍。

我本次考试的4个集群全都没有启动,需要自己按条件部署后启动。

- 第三:考试时间3个小时。

10-12道题,在熟悉文档的前提下,每个题目都需要争分夺秒、分秒必争。

7.5 考取认证有什么用?

第一:Elastic总部官方认可。

来自Elastic官方的认可,不容小觑。是对你实践能力的认可。

第二:含金量高。

-

Elastic官方、社区大佬wood大叔、极客时间阮一鸣老师都强调过这个证书含金量很高。

- 他不同于工信部的软考、PMP考试考的是理论能力、理解能力,全国每年几万人甚至十几万人都能通过,甚至在校大学生背背也能通过,

Elastic认证没有实践过几乎100%通不过的。

第三:“升职加薪”。

- 如果你考虑换工作,可以作为很好的敲门砖。

- 如果你是面试官,应聘者通过认证,基础的Elastic实战问题说明已经非常熟练了,极大的提高你的招聘质量。

- 如果你是职场人士或在校学生族,熟悉考点的过程也是你加强Elastic认知的过程。

最强大脑Dr魏在得到的课程中提到:"认知科学成果表明,提取记忆过程,特别是用考试作为手段的提取方式,不仅有学习的作用,甚至比简单的重复学习效果更好。”

7.6 一次通过的吗?

很遗憾,我也不是一次性通过的。

-

2019年7月份考过一次,当时只简单过了一遍文档,很多地方没有实际敲过,考试一紧张,11道题只完成8道。 没过总结的原因无非两字:不熟。其他都是借口。

- 2019年12月7日参加完Elastic开发者大会后,很有触动,又开始重新准备考试,侧重实战。

7.7 有没有可参考的复习计划?

2019年下半年,杭州的一次meetup分享很受用,我按照他的表格做了知识点的梳理和大致实践规划。

大致分三个阶段。

- 阶段1:熟悉官方文档。

官方文档+案例敲一遍,相关数据可以使用kibana提供的3种数据集。

这个时候遇到的任何问题自己解决不了,都可以抛出来中英文社区讨论,直到彻底懂了。

- 阶段2:真题模拟,记录不熟的知识点。

我记录的一些核心点如下:

(1)parent/child

(2)nested

(3)script+ingest pipeline

(4)function_score

(5)dis_max, multi_fields(cross fields, most_fields, best_fields)

(6)security+role

(7)search template

(8)cross cluster search

(10)custom analyzer

(11)shard allocation

(12)cluster diagnose

(13)backup restore

(14)hot-ware deployment

(15)mapping muti-fields

(16)settings+analyzer+

(17)update+search+reindex script

(18) template+alias- 阶段3:查缺补漏,重点突击。

基础已经基本熟悉了,对于第二阶段发现的问题,细节再过一遍文档,查缺补漏,确保万无一失。

- 阶段4:迎战考试。

快速翻文档和1-3环节技术点,多过几遍。能o(1)时间找到文档位置。

以上三个过程,全环节都需要实战演练。

1-3阶段可以放慢速度,求稳、求准。

第4阶段适度进展,迎战考试,确保没有遗漏,确保能最快时间定位文档。

7.8 这次考了哪些题?

1、terms聚合分析

2、跨集群检索

3、4节点跨集群分片副本感知分配

5、用户角色、用户名密码指定

6、动态模板template

7、reindex+ingest pipeline

8、检索+提升评分权重

9、自定义mapping+multi-fields

10、检索+排序+高亮+等

这次考试好几个题目的题干都很长。

7.9 你考试花了多长时间?

- 2019年12月8日重新定下目标考试,2020年2月3日参加考试。

- 期间只有晚上10点到12点左右有时间。临考前2天准备了2个整天。

- 中间有别的事情+春节,断过几天。

7.10 平时工作那么忙、哪有时间考试?

- 的确,这是大家通病。年底都忙,过年也忙。

- 自己挤时间,我为了准备考试,12月8日——2月5日,朋友圈彻底关闭、一切新闻客户端彻底删除。不狠一把,你都不知道自己有多厉害!

- 期间也有想放弃的时候,就听一下俞敏洪一分钟励志演讲,管用!新东方的励志语录也萦绕在耳边“坚持下去不是因为我很坚强,而是我别无选择”。

- 特殊期间,正是提升内功的绝佳时机。看别的只会让你焦虑和恐慌,做好自己就是对国家的贡献。

- 如果你平时工作中就一直使用Elasticsearch,可以平时的时候刻意注意熟悉实践文档。我看腾讯大佬们的分享都很轻松,不用我写的这么“悲壮”。

8、考过了就牛逼了吗?

大错特错,考试说白了只能证明你文档熟+实践能力强。 并不能说明你底层原理熟悉+源码熟悉,离大佬还差十万八千里。 真正的大佬是:

- 以medcl等大佬为代表的Elastic原厂技术团队;

- 以wood大佬+阮一鸣等大佬为代表的大厂企业级实战派;

- 以魏彬等大佬为代表的咨询专家团队;

- 以张超等大佬为代表的源码原理派。

多向他们学习和求经,能获益良多。

9、小结

著名相声表演艺术家常宝华曾这样评价侯宝林大师:“在他面前,我就像不会(说相声)似的”。

我认为这句话对技术人员一样受用。技术的道路上,我们要谨记这句话。

-

一方面:新技术层出不穷,不要抱残守缺,要拥抱变化。同时注意底层原理大多是相通的,要深挖,不要浮于表面。

- 另一方面:保持对技术的敬畏和好奇之心,热爱自己的热爱、坚持自己的坚持。

专研技术的同时要多向身边或者网上的牛人学习。一个人可能走得更快,但一群人走得更远。

文章标题的来源自偶像俞敏洪老师公众号对粉丝的回复:

和大家共勉!

潜心一技、做到极致。

和你一起,死磕Elastic!

收起阅读 »社区日报 第847期 (2020-01-18)

社区日报 第846期 (2020-01-17)

http://t.cn/A6vKNqwX

2、Elasticsearch——stream读写的实践

http://t.cn/A6vKKQhX

3、年度盘点:Elasticsearch干货手册

http://t.cn/A6vMUUMq

编辑:铭毅天下

归档:https://ela.st/cn-daily-all

订阅:https://ela.st/cn-daily-sub

沙龙:https://ela.st/cn-meetup

http://t.cn/A6vKNqwX

2、Elasticsearch——stream读写的实践

http://t.cn/A6vKKQhX

3、年度盘点:Elasticsearch干货手册

http://t.cn/A6vMUUMq

编辑:铭毅天下

归档:https://ela.st/cn-daily-all

订阅:https://ela.st/cn-daily-sub

沙龙:https://ela.st/cn-meetup 收起阅读 »

社区日报 第845期 (2020-01-16)

http://t.cn/A6vxfI4J

2、如何使用React和ElasticSearch模拟构建Airbnb

http://t.cn/A6vxf6wd

3、使用StormCrawler和Elasticsearch进行Web抓取(梯子)

http://t.cn/A6vxfKh4

编辑:铭毅天下

归档:https://ela.st/cn-daily-all

订阅:https://ela.st/cn-daily-sub

沙龙:https://ela.st/cn-meetup

http://t.cn/A6vxfI4J

2、如何使用React和ElasticSearch模拟构建Airbnb

http://t.cn/A6vxf6wd

3、使用StormCrawler和Elasticsearch进行Web抓取(梯子)

http://t.cn/A6vxfKh4

编辑:铭毅天下

归档:https://ela.st/cn-daily-all

订阅:https://ela.st/cn-daily-sub

沙龙:https://ela.st/cn-meetup 收起阅读 »

社区日报 第844期 (2020-01-15)

http://t.cn/A6vqkJuF

2.深入理解Elasticsearch写入过程

http://t.cn/AiBlrpMC

3.Elasticsearch如何处理存在关联关系的数据?

http://t.cn/A6vt05qc

编辑:金桥

归档:https://ela.st/cn-daily-all

订阅:https://ela.st/cn-daily-sub

沙龙:https://ela.st/cn-meetup

http://t.cn/A6vqkJuF

2.深入理解Elasticsearch写入过程

http://t.cn/AiBlrpMC

3.Elasticsearch如何处理存在关联关系的数据?

http://t.cn/A6vt05qc

编辑:金桥

归档:https://ela.st/cn-daily-all

订阅:https://ela.st/cn-daily-sub

沙龙:https://ela.st/cn-meetup 收起阅读 »

社区日报 第843期 (2020-01-14)

http://t.cn/A6v4Abyo

2、Elasticsearch调优篇-慢查询分析笔记。

http://t.cn/A6vwaNXM

3、使用Elasticsearch实现Spring Boot的自动完成功能。

http://t.cn/A6vwaWhs

编辑:叮咚光军

归档:https://ela.st/cn-daily-all

订阅:https://ela.st/cn-daily-sub

http://t.cn/A6v4Abyo

2、Elasticsearch调优篇-慢查询分析笔记。

http://t.cn/A6vwaNXM

3、使用Elasticsearch实现Spring Boot的自动完成功能。

http://t.cn/A6vwaWhs

编辑:叮咚光军

归档:https://ela.st/cn-daily-all

订阅:https://ela.st/cn-daily-sub 收起阅读 »

社区日报 第841期 (2020-01-13)

http://t.cn/AisF0pA1

2、kibana-6-8-以上版本在k8s-ingress中的负载均衡设置

http://t.cn/AisF8fD0

3、elasticsearch助力TiDB实现全文搜索

http://t.cn/AiDZFOpD

编辑:cyberdak

归档:https://ela.st/cn-daily-all

订阅:https://ela.st/cn-daily-sub

沙龙:https://ela.st/cn-meetup

http://t.cn/AisF0pA1

2、kibana-6-8-以上版本在k8s-ingress中的负载均衡设置

http://t.cn/AisF8fD0

3、elasticsearch助力TiDB实现全文搜索

http://t.cn/AiDZFOpD

编辑:cyberdak

归档:https://ela.st/cn-daily-all

订阅:https://ela.st/cn-daily-sub

沙龙:https://ela.st/cn-meetup 收起阅读 »

社区日报 第840期 (2020-01-12)

http://t.cn/AisgoVAJ

2.(自备梯子)如何使用Kibana在GCP上部署和监视Honeypots[教程]。

http://t.cn/Aisgmxt7

3.数字企业转型的关键。

http://t.cn/AislCqU6

编辑:至尊宝

归档:https://ela.st/cn-daily-all

订阅:https://ela.st/cn-daily-sub

沙龙:https://ela.st/cn-meetup

http://t.cn/AisgoVAJ

2.(自备梯子)如何使用Kibana在GCP上部署和监视Honeypots[教程]。

http://t.cn/Aisgmxt7

3.数字企业转型的关键。

http://t.cn/AislCqU6

编辑:至尊宝

归档:https://ela.st/cn-daily-all

订阅:https://ela.st/cn-daily-sub

沙龙:https://ela.st/cn-meetup 收起阅读 »

社区日报 第839期 (2020-01-11)

社区日报 第838期 (2020-01-10)

http://t.cn/AisNqs4u

2、Elasticsearch Rust Client 7.X发布

http://t.cn/AisN5hiG

3、用react和Elasticsearch实现电影搜索APP(梯子)

http://t.cn/RdYmJ8R

编辑:铭毅天下

归档:https://ela.st/cn-daily-all

订阅:https://ela.st/cn-daily-sub

沙龙:https://ela.st/cn-meetup

http://t.cn/AisNqs4u

2、Elasticsearch Rust Client 7.X发布

http://t.cn/AisN5hiG

3、用react和Elasticsearch实现电影搜索APP(梯子)

http://t.cn/RdYmJ8R

编辑:铭毅天下

归档:https://ela.st/cn-daily-all

订阅:https://ela.st/cn-daily-sub

沙龙:https://ela.st/cn-meetup

收起阅读 »