ik 停用词停用后,如何做到搜索结果中的停用词也高亮。

simaGang 回复了问题 • 3 人关注 • 2 个回复 • 1587 次浏览 • 2022-03-28 17:12

手动执行forceMerge索引后,由于磁盘空间不够失败,索引变red,磁盘空间也没有释放,请问怎么恢复?

zmc 回复了问题 • 2 人关注 • 1 个回复 • 3095 次浏览 • 2022-01-04 21:34

es 按照某个field 聚合后,如何得到一有多少组?

tangjw 回复了问题 • 2 人关注 • 2 个回复 • 2199 次浏览 • 2022-01-04 14:00

es索引存储膨胀过快的原因?

laoyang360 回复了问题 • 2 人关注 • 1 个回复 • 2503 次浏览 • 2022-01-02 21:34

关于《深入理解ElasticSearch》中对于"~"的一点疑问

Ombres 回复了问题 • 2 人关注 • 1 个回复 • 1984 次浏览 • 2021-12-29 14:33

【1月8日】Elastic 中国开发者大会 2021 日程新鲜出炉!福利票抢先购!

liaosy 发表了文章 • 0 个评论 • 5534 次浏览 • 2021-12-27 21:46

重要的事情说三遍

- Elastic 中国开发者大会 2021 的精彩日程现已上线!

- Elastic 中国开发者大会 2021 的精彩日程现已上线!

- Elastic 中国开发者大会 2021 的精彩日程现已上线!

关于本次大会

Elastic 中国开发者大会 2021 是由 Elastic 官方、Elastic 中文社区和极限科技联合主办的开发者大会,作为中国国内唯一一个专门讨论 Elasticsearch 开源技术的大会,是中国最权威和最具实力干货的技术大会,其专业性和内容的质量一直以来在业内都是有口皆碑。本次大会邀请的演讲嘉宾有来自 Elastic 官方、Google、腾讯、阿里巴巴、字节跳动、vivo等众多公司的技术专家,为中国广大的 Elasticsearch 开发者提供一个技术交流和学习切磋的地方,汇集业界众多的成功案例,集思广益,发散思维,促进社区和行业的进步。

更多详细介绍请参见大会官网:

[https://conf.elasticsearch.cn](https://conf.elasticsearch.cn/2021/index.html)

关于大会议程

精彩内容不容错过,八折购票火热进行中(折扣码: 80OFF),扫码购买。

es 7.10 嵌套文档的聚合对被嵌套的文档筛选不生效的问题。

Ombres 回复了问题 • 4 人关注 • 3 个回复 • 2002 次浏览 • 2021-12-21 17:38

2万多索引单节点,集群重启后,自动分片到2万集群就会挂掉

tongchuan1992 回复了问题 • 3 人关注 • 3 个回复 • 1987 次浏览 • 2021-12-27 10:03

Elastic 7.16 版:精简的数据集成驱动重要的结果

liuxg 发表了文章 • 0 个评论 • 1637 次浏览 • 2021-12-14 18:44

我们很高兴地宣布 Elastic 7.16 版正式发布,这个版本为 Elastic Search Platform(包括 Elasticsearch 和 Kibana)及其三个内置解决方案(Elastic 企业搜索、Elastic 可观测性和 Elastic 安全)带来一系列广泛的全新功能。

Elastic 7.16 版简化了将各类数据从任何来源采集到 Elastic Search Platform 的过程。这个版本引入了数十个预构建的 Elastic 代理数据集成、适用于持续集成和持续交付 (CI/CD) 管道的可观测性工具、两个新获认证的 ServiceNow 应用程序,以及 Amazon Web Services (AWS) 和 Elastic Cloud 之间的原生数据集成,极大扩展了对复杂的分布式云原生服务的可见性。

此外,Elastic 企业搜索的一体化用户界面现已在 Kibana 中正式上线,让您可以更轻松地使用强大的可视化功能深入了解最终用户的搜索体验。而且,由自适应相关性提供支持的搜索结果管理功能现已推出公测版,这样一来,Elastic App Search 用户可以利用收集到的分析和自动建议,打造更好的搜索体验。

从改善最终用户的搜索体验,到使用临时分析加快故障排除速度、扩展管道构建和部署的可见性,以及保护终端免受高级威胁的影响,Elastic 7.16 版的正式发布,将能够协助组织打造出色的搜索体验,提升解决问题的能力,为组织取得成功助一臂之力。

详细阅读,请参阅 https://elasticstack.blog.csdn ... 50764

Elastic:在 CentOS 上一步一步安装 Elastic Stack

liuxg 发表了文章 • 0 个评论 • 1607 次浏览 • 2021-12-14 17:18

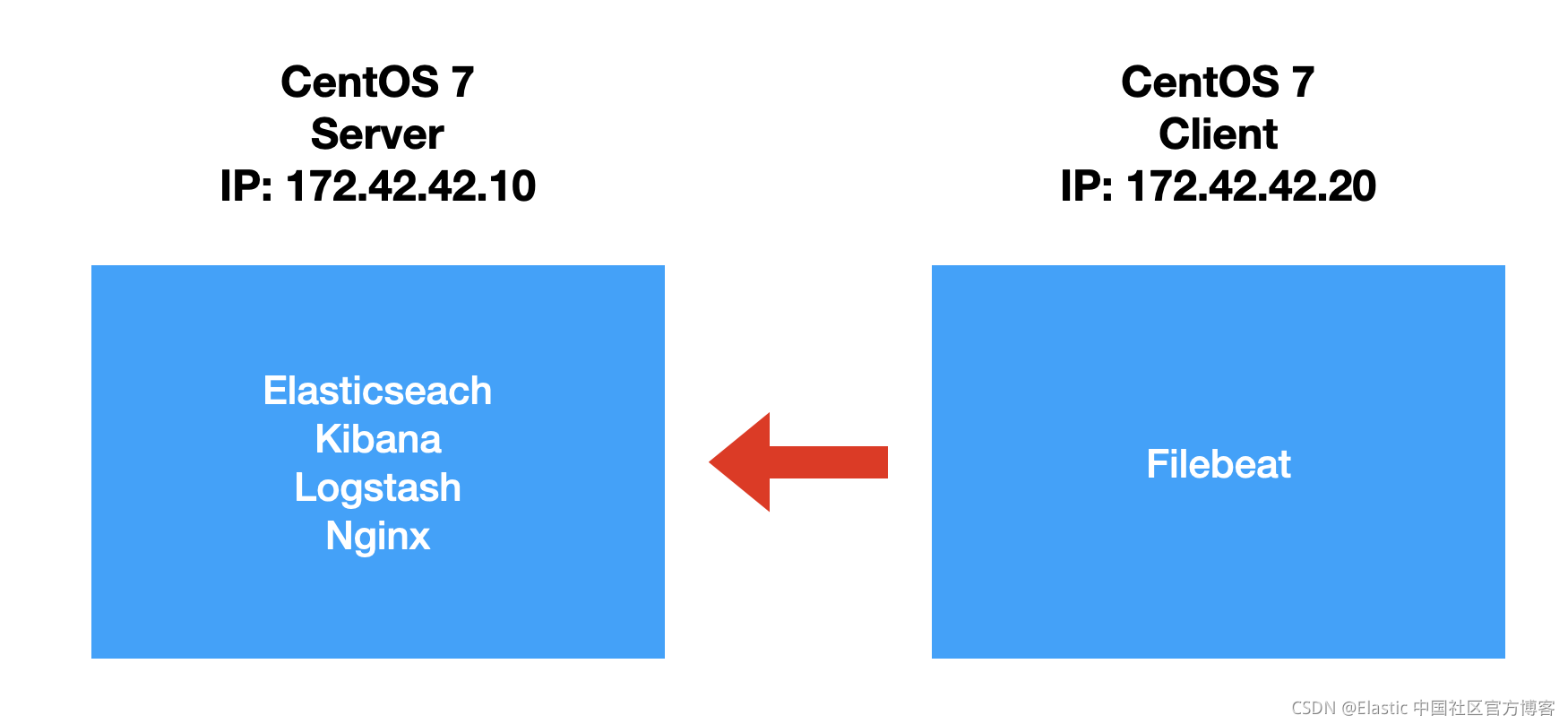

如果你从来还没有安装过 Vagrant,请参照我之前的教程 “Vagrant 入门教程” 来进行学习。在今天的练习中,我们使用如下的配置:

详细阅读,请参阅 https://elasticstack.blog.csdn ... 14413